iSCSI 服务器

多路径是指服务器和存储阵列存在多个物理连接方式使用虚拟设备,这种方式可以提供更加弹性的存储连接(一个路径down掉不会影响连接性),也可以聚合存储带宽提供性能。示例:多路径由dm-multipath子系统提供,使用内核device mapper系统获得虚拟设备,有multipathd进程和multipath命令行工具管理。软件包device-mapper-multipath提供必要的binarie

iSCSI 服务器

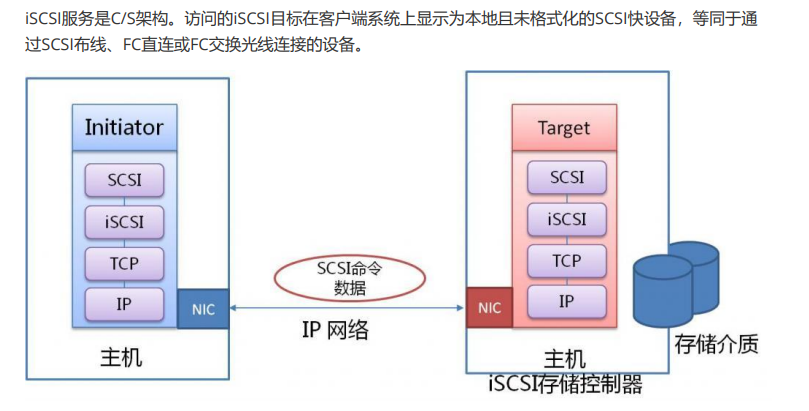

iSCSI 服务介绍

SCSI(Small Computer System Interface,小型计算机系统接口),一种用于计算机和智能设备之间

(硬盘、软驱、光驱、打印机、扫描仪等)连接标准。

iSCSI(Internet Small Computer System Interface,Internet 小型计算机系统接口),又称为IP-SAN,

是IBM公司研究开发的IP SAN技术,该技术是将现有SCSI接口与以太网络(Ethernet)技术结合,基于TCP/IP的协议连接iSCSI服务端(Target)和客户端(Initiator),使得封装后的SCSI数据包可以在互联网传输,最终实现iSCSI服务端提供存储给客户端。

通常,iSCSI使用专用的10 Gb以太网或更好的网络,以最大程度地提高性能。

从物理服务器到存储的电缆通常封闭在数据中心内,并且理想情况下不直接连接到LAN网络,所以SAN流

量通常不加密,以最大程度地提高性能。 为了实现WAN安全,iSCSI管理员可以使用IPsec加密流量。

iSCSI 架构

配置 iSCSI Targets

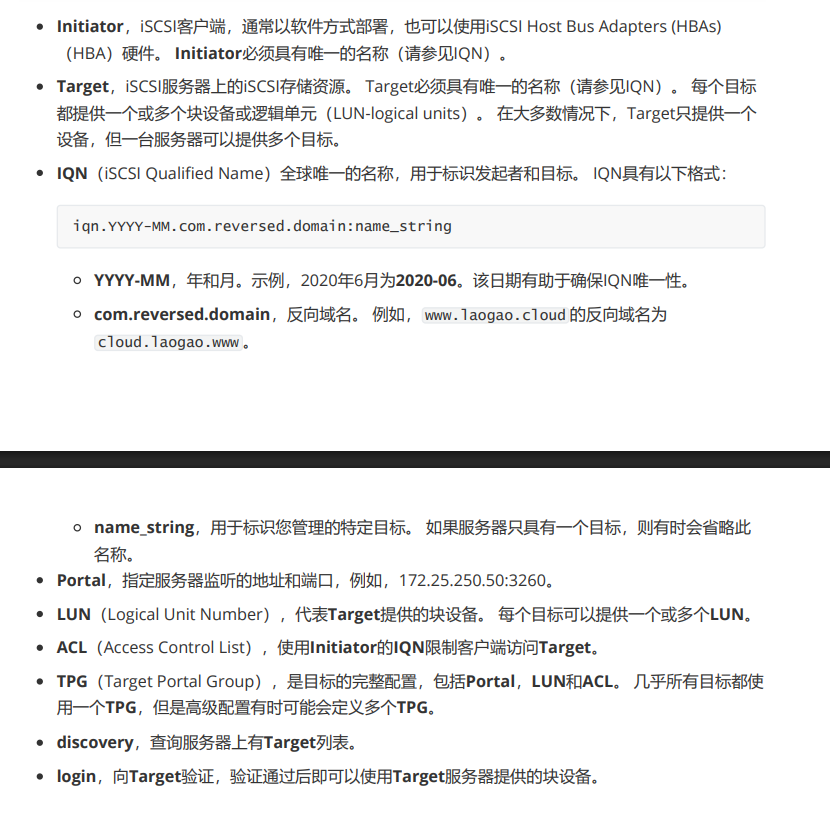

节点规划

配置流程

先建 backstores/block 绑定本地硬盘\分区

再建 iscsi 目标

绑定 LUN

设置权限

客户端连接使用

配置iscsi-server

配置 iSCSI Targets需要安装以下软件:

targetd,服务端软件。

targetcli,targetd服务配置工具。

# 安装软件

[root@iscsi-server ~]# yum install -y targetd targetcli

# 启用并启动服务

[root@iscsi-server ~]# systemctl enable target --now

# 配置防火墙

[root@iscsi-server ~]# firewall-cmd --permanent --add-service=iscsi-target

[root@iscsi-server ~]# firewall-cmd --reload

当您不带任何选项运行targetcli时,该命令将进入交互模式。

在以下示例中,使用ls命令显示当前布局。

[root@iscsi-server ~]# targetcli

targetcli shell version 2.1.53

Copyright 2011-2013 by Datera, Inc and others.

For help on commands, type 'help'.

/> ls

o- /

.................................................................................

...... [...]

o- backstores

............................................................................

[...]

| o- block ................................................................

[Storage Objects: 0]

| o- fileio ...............................................................

[Storage Objects: 0]

| o- pscsi ................................................................

[Storage Objects: 0]

| o- ramdisk ..............................................................

[Storage Objects: 0]

o- iscsi

..........................................................................

[Targets: 0]

o- loopback

....................................................................... [Targets:

0]

/>

配置 backstore 对象

backstore类型:

- block:服务器中的块设备,例如磁盘驱动器,磁盘分区或逻辑卷。

- fileio:本地文件系统中的常规文件。targetcli将该文件用作磁盘映像。

- pscsi:物理SCSI设备。 这种类型的存储允许客户端通过网络访问服务器上的物理SCSI设备。

- ramdisk:内存中的磁盘设备。 这种类型的存储不会持久存储数据。 服务器重新启动后,数据将丢

失。

要使用targetcli创建后备存储,请使用其create命令。 该命令的行为取决于您在配置树中的当前位置。

示例:

先进目录,再 create(最常用、最简单)

/> cd /backstores/block

/backstores/block> create myblock1 /dev/sdb

Created block storage object myblock1 using /dev/sdb.

等同于用 full path 写法(必须带 /)

/> /backstores/block create myblock1 /dev/sdb

Created block storage object myblock1 using /dev/sdb.

配置 Target IQN

在/iscsi伪目录中,创建IQN,将您选择的IQN名称作为其第一个参数

/> cd /iscsi

/iscsi> create iqn.2026-04.cloud.s.iscsi-server:disk1

Created target iqn.2026-04.cloud.s.iscsi-server:disk1.

Created TPG 1.

Global pref auto_add_default_portal=true

Created default portal listening on all IPs (0.0.0.0), port 3260.

/iscsi> ls

o- iscsi

............................................................................

[Targets: 1]

o- iqn.2026-04.cloud.s.iscsi-server:disk1

....................................... [TPGs: 1]

# 共享块

o- tpg1 ............................................................... [nogen-acls, no-auth]

# access controller list 访问控制列表,控制谁可以访问我

o- acls

.......................................................................... [ACLs:

0]

# 定义设备列表

o- luns

.......................................................................... [LUNs:

0]

# 门户,通过哪个ip和哪个接口访问我

o- portals

.................................................................... [Portals: 1]

o- 0.0.0.0:3260

..................................................................... [OK]

/iscsi>

配置 LUN

# 把提前做好的后端存储 myblock1(也就是 /dev/sdb)绑定成 LUN,对外共享

/> cd /iscsi/iqn.2026-04.cloud.s.iscsi-server:disk1/tpg1/luns

/iscsi/iqn.20...sk1/tpg1/luns> create /backstores/block/myblock1

Created LUN 0.

配置 ACL

创建ACL,以允许客户端启动程序访问目标。在Red Hat Enterprise Linux上,启动器的IQN存储在/etc/iscsi/initiatorname.iscsi文件中。

/> cd /iscsi/iqn.2026-04.cloud.s.iscsi-server:disk1/tpg1/acls

/iscsi/iqn.20...sk1/tpg1/acls> create iqn.2026-04.cloud.s.iscsi-client

Created Node ACL for iqn.2026-04.cloud.s.iscsi-client

Created mapped LUN 0.

配置 Portal

删掉默认: 0.0.0.0:3260 (随便哪个 IP 都能连)

新建指定: 10.1.8.10:3260

! 只允许通过 10.1.8.10 这个网卡连接 iSCSI 共享

/> cd /iscsi/iqn.2026-04.cloud.s.iscsi-server:disk1/tpg1/portals/

/iscsi/iqn.20.../tpg1/portals> delete 0.0.0.0 3260

Deleted network portal 0.0.0.0:3260

/iscsi/iqn.20.../tpg1/portals> create 10.1.8.10 3260

Using default IP port 3260

Created network portal 10.1.8.10:3260.

保存配置

退出targetcli shell时,该命令将配置保存在/etc/target/saveconfig.json文件中。

/> exit

Global pref auto_save_on_exit=true

Configuration saved to /etc/target/saveconfig.json

非交互式管理 Targets

[root@iscsi-server ~]# targetcli /backstores/block create myblock2 /dev/sdc

Created block storage object myblock2 using /dev/sdc.

[root@iscsi-server ~]# targetcli /iscsi create iqn.2026-04.cloud.s.iscsiserver:disk2

Created target iqn.2026-04.cloud.s.iscsi-server:disk2.

Created TPG 1.

Global pref auto_add_default_portal=true

Created default portal listening on all IPs (0.0.0.0), port 3260.

[root@iscsi-server ~]# targetcli /iscsi/iqn.2026-04.cloud.s.iscsiserver:disk2/tpg1/luns create /backstores/block/myblock2

Created LUN 0.

[root@iscsi-server ~]# targetcli /iscsi/iqn.2026-04.cloud.s.iscsiserver:disk2/tpg1/acls create iqn.2026-04.cloud.s.iscsi-client

Created Node ACL for iqn.2026-04.cloud.s.iscsi-client

Created mapped LUN 0.

[root@iscsi-server ~]# targetcli /iscsi/iqn.2026-04.cloud.s.iscsiserver:disk2/tpg1/portals delete 0.0.0.0 3260

Deleted network portal 0.0.0.0:3260

[root@iscsi-server ~]# targetcli /iscsi/iqn.2026-04.cloud.s.iscsiserver:disk2/tpg1/portals create 10.1.8.10 3260

Using default IP port 3260

Created network portal 10.1.8.10:3260.

[root@iscsi-server ~]# targetcli saveconfig

Last 10 configs saved in /etc/target/backup/.

Configuration saved to /etc/target/saveconfig.json

提示:与交互式使用targetcli不同,命令行模式必须显式运行saveconfig子命令以保存配置。

访问 iSCSI 存储

iSCSI 启动器通常以软件方式实现。 使用基于软件的iSCSI启动器需要连接到具有足够带宽的现有以太网网络,以承载存储流量。

您也可以使用硬件启动器-主机总线适配器(HBA),从而减轻了其他系统资源的负担。

准备客户端系统

配置iSCSI客户端启动程序需要安装iscsi-initiator-utils软件包,该软件包包括iscsi和iscsid服务以及/etc/iscsi/iscsid.conf和/etc/iscsi/initiatorname.iscsi配置文件。

[root@iscsi-client ~]# yum install -y iscsi-initiator-utils

作为iSCSI启动器,客户端需要其自己的唯一iSCSI合格名称(IQN)。在安装iscsi-initiator-utils的过程中,该软件包生成唯一的IQN,并存储到/etc/iscsi/initiatorname.iscsi文件中。 管理员通常需要更改该名称。

[root@iscsi-client ~]# vim /etc/iscsi/initiatorname.iscsi

InitiatorName=iqn.2026-04.cloud.s.iscsi-client

/etc/iscsi/iscsid.conf文件包含您连接的目标的默认设置。 这些设置包括iSCSI超时,重试以及用于身份验证的用户名和密码参数。

软件包安装会自动配置iscsid服务,以便启动器在系统启动时自动重新连接到任何已发现的目标。 每当您修改启动程序的配置文件时,请重新启动iscsid服务。

连接 iSCSI 目标

在使用远程设备之前,首先需要发现目标。 发现过程使用/etc/iscsi/iscsid.conf中的配置将目标信息和设

置存储在/var/lib/iscsi/nodes/目录中。

您可以使用以下命令执行远程目标的发现:

# iscsiadm -m discovery -t st -p portal_ip[:port]

参数说明:

- portal_ip参数是目标门户的IP地址。

- 如果未指定port参数,它将使用默认端口3260。

示例:

[root@iscsi-client ~]# iscsiadm -m discovery -t st -p 10.1.8.10

10.1.8.10:3260,1 iqn.2026-04.cloud.s.iscsi-server:disk2

10.1.8.10:3260,1 iqn.2026-04.cloud.s.iscsi-server:disk1

要使用列出的目标之一,请使用以下命令登录到该目标:

# iscsiadm -m node -T Target -p portal_ip[:port] -l

示例:

[root@iscsi-client ~]# iscsiadm -m node -T iqn.2026-04.cloud.s.iscsiserver:disk1 -l

Logging in to [iface: default, target: iqn.2026-04.cloud.s.iscsiserver:disk1, portal: 10.1.8.10,3260] (multiple)

Login to [iface: default, target: iqn.2026-04.cloud.s.iscsi-server:disk1,

portal: 10.1.8.10,3260] successful.

此时,系统将检测到新的SCSI块设备,就好像它是本地连接的硬盘驱动器一样。 您可以使用以下命令查

看新设备,该命令以打印级别3显示有关当前iSCSI登录会话的信息。

[root@iscsi-client ~]# lsblk

NAME MAJ:MIN RM SIZE RO TYPE MOUNTPOINT

sda 8:0 0 200G 0 disk

├─sda1 8:1 0 1G 0 part /boot

└─sda2 8:2 0 199G 0 part

├─centos-root 253:0 0 50G 0 lvm /

├─centos-swap 253:1 0 7.9G 0 lvm [SWAP]

└─centos-home 253:2 0 141.1G 0 lvm /home

sdb 8:16 0 20G 0 disk #从iscsi-server来的

sr0 11:0 1 4.4G 0 rom

[root@iscsi-client ~]# iscsiadm -m session -P 3

iSCSI Transport Class version 2.0-870

version 6.2.0.874-22

Target: iqn.2026-04.cloud.s.iscsi-server:disk1 (non-flash)

Current Portal: 10.1.8.10:3260,1

Persistent Portal: 10.1.8.10:3260,1

**********

Interface:

**********

Iface Name: default

Iface Transport: tcp

Iface Initiatorname: iqn.2026-04.cloud.s.iscsi-client

Iface IPaddress: 10.1.8.11

Iface HWaddress: <empty>

Iface Netdev: <empty>

SID: 1

iSCSI Connection State: LOGGED IN

iSCSI Session State: LOGGED_IN

Internal iscsid Session State: NO CHANGE

*********

Timeouts:

*********

Recovery Timeout: 120

Target Reset Timeout: 30

LUN Reset Timeout: 30

Abort Timeout: 15

*****

CHAP:

*****

username: <empty>

password: ********

username_in: <empty>

password_in: ********

************************

Negotiated iSCSI params:

************************

HeaderDigest: None

DataDigest: None

MaxRecvDataSegmentLength: 262144

MaxXmitDataSegmentLength: 262144

FirstBurstLength: 65536

MaxBurstLength: 262144

ImmediateData: Yes

InitialR2T: Yes

MaxOutstandingR2T: 1

************************

Attached SCSI devices:

************************

Host Number: 3 State: running

scsi3 Channel 00 Id 0 Lun: 0

Attached scsi disk sdb State: running

或者,您可以查看 dmesg , tail /var/log/messages 或 ls -l /dev/disk/by-path/iscsi 命令的

输出。 该登录过程在重新启动后将保持不变。 因此,启动后块设备将自动可用。

格式化 iSCSI 设备

如果发现的块设备已经具有分区,文件系统或LVM卷,则可以使用常规命令(如mount)访问该数据。

您可以使用lsblk --fs命令检查设备。

[root@iscsi-client ~]# blkid

/dev/sda1: UUID="53d865c3-ed9c-4070-86dc-84558ed00ed1" TYPE="xfs"

/dev/sda2: UUID="yNXcrK-NYTG-XipO-fTBm-qmZf-bXbB-2fTRGj" TYPE="LVM2_member"

/dev/sr0: UUID="2020-11-04-11-36-43-00" LABEL="CentOS 7 x86_64" TYPE="iso9660"

PTTYPE="dos"

/dev/mapper/centos-root: UUID="71832a0b-fdc4-4797-86d9-7872593b23d6" TYPE="xfs"

/dev/mapper/centos-swap: UUID="9d24a0c3-dc8b-4635-b542-d4ddbb5a3aab" TYPE="swap"

/dev/mapper/centos-home: UUID="39f98448-d5e3-490e-8b8f-922773ada8da" TYPE="xfs"

多个启动程序同时从同一目标安装同一文件系统,会导致文件系统损坏或尝试读取数据时出现不一

致。 本地文件系统(例如ext4或XFS)不支持从多个系统并发安装。如果需要允许从多个系统同时访

问基于iSCSI的块设备,请使用群集文件系统(例如GFS2)。

如果磁盘为空,则可以对其进行格式化,创建分区或将其用作LVM物理卷。

# 假设客户端发现的设备名称是/dev/sdb

[root@iscsi-client ~]# mkfs.xfs /dev/sdb

meta-data=/dev/sdb isize=512 agcount=4, agsize=1310720 blks

= sectsz=512 attr=2, projid32bit=1

= crc=1 finobt=0, sparse=0

data = bsize=4096 blocks=5242880, imaxpct=25

= sunit=0 swidth=0 blks

naming =version 2 bsize=4096 ascii-ci=0 ftype=1

log =internal log bsize=4096 blocks=2560, version=2

= sectsz=512 sunit=0 blks, lazy-count=1

realtime =none

[root@iscsi-client ~]# blkid

/dev/sda1: UUID="53d865c3-ed9c-4070-86dc-84558ed00ed1" TYPE="xfs"

/dev/sda2: UUID="yNXcrK-NYTG-XipO-fTBm-qmZf-bXbB-2fTRGj" TYPE="LVM2_member"

/dev/sr0: UUID="2020-11-04-11-36-43-00" LABEL="CentOS 7 x86_64" TYPE="iso9660"

PTTYPE="dos"

/dev/mapper/centos-root: UUID="71832a0b-fdc4-4797-86d9-7872593b23d6" TYPE="xfs"

/dev/mapper/centos-swap: UUID="9d24a0c3-dc8b-4635-b542-d4ddbb5a3aab" TYPE="swap"

/dev/mapper/centos-home: UUID="39f98448-d5e3-490e-8b8f-922773ada8da" TYPE="xfs"

/dev/sdb: UUID="81629560-cb56-4c19-814f-7f946d731b02" TYPE="xfs"

# 挂载测试

[root@iscsi-client ~]# mkdir /sdb

[root@iscsi-client ~]# mount /dev/sdb /sdb

[root@iscsi-client ~]# echo xixihaha > /sdb/test

[root@iscsi-client ~]# cat /sdb/test

xixihaha

[root@iscsi-client ~]# lsblk

NAME MAJ:MIN RM SIZE RO TYPE MOUNTPOINT

sda 8:0 0 200G 0 disk

├─sda1 8:1 0 1G 0 part /boot

└─sda2 8:2 0 199G 0 part

├─centos-root 253:0 0 50G 0 lvm /

├─centos-swap 253:1 0 7.9G 0 lvm [SWAP]

└─centos-home 253:2 0 141.1G 0 lvm /home

sdb 8:16 0 20G 0 disk /sdb

sdc 8:32 0 20G 0 disk

sr0 11:0 1 4.4G 0 rom /run/media/root/CentOS 7 x86_64

[root@iscsi-client ~]#

持久化挂载

在/etc/fstab中的iSCSI目标上持久地挂载文件系统时,请确保遵循以下建议:

- 使用文件系统UUID挂载。 不要使用设备名称( /dev/sd* )。 设备的名称取决于 iSCSI 设备通过

网络响应的顺序,因此设备名称可能会在引导之后更改。如果在 /etc/fstab 中使用设备名称,则系

统可能会将设备挂载在错误的挂载点下。 - 在/etc/fstab中使用 _netdev 挂载选项。 因为iSCSI依赖网络访问远程设备,所以此选项可确保在网

络和启动器启动之前,系统不会尝试挂载文件系统。

[root@iscsi-client ~]# vim /etc/fstab

UUID="81629560-cb56-4c19-814f-7f946d731b02" /data xfs defaults,_netdev 0 0

还需要确保服务iscsi开机自动启动,该服务默认是开机自动启动的。

[root@iscsi-client ~]# systemctl enable iscsi

断开目标连接

要停止使用iSCSI目标,请执行以下步骤:

- 确保没有使用目标提供的任何设备。 例如,卸载文件系统。

- 从/etc/fstab等位置删除对目标的所有持久引用。

- 从iSCSI目标注销。

[root@iscsi-client ~]# umount /data

[root@iscsi-client ~]# iscsiadm -m node -T iqn.2026-04.cloud.s.iscsiserver:disk1 -p 10.1.8.10:3260 -u

Logging out of session [sid: 2, target: iqn.2026-04.cloud.s.iscsiserver:disk1, portal: 10.1.8.10,3260]

Logout of [sid: 2, target: iqn.2026-04.cloud.s.iscsi-server:disk1,

portal: 10.1.8.10,3260] successful.

[root@iscsi-client ~]# iscsiadm -m session

tcp: [1] 10.1.8.10:3260,1 iqn.2026-04.cloud.s.iscsi-server:disk2 (nonflash)

[root@iscsi-client ~]# iscsiadm -m node

10.1.8.10:3260,1 iqn.2026-04.cloud.s.iscsi-server:disk2

10.1.8.10:3260,1 iqn.2026-04.cloud.s.iscsi-server:disk1

- 删除 iSCSI目标的本地记录,以使启动器在引导过程中不会自动登录到目标。

[root@iscsi-client ~]# iscsiadm -m node -T iqn.2026-04.cloud.s.iscsiserver:disk1 -p 10.1.8.10:3260 -o delete

[root@iscsi-client ~]# iscsiadm -m node

10.1.8.10:3260,1 iqn.2026-04.cloud.s.iscsi-server:disk2

故障处理

如果发现成功,但是启动器登录到发现的目标时遇到问题,则该问题很可能与访问控制或身份验证有

关。客户端上的IQN与服务器上的IQN不匹配会导致目标登录失败。

可能是客户端上的启动器IQN不正确引起的,请在客户端的/etc/iscsi/initiatorname.iscsi文件中修复

IQN,然后重新启动iscsid服务以使更改生效。

[root@iscsi-client ~]# vim /etc/iscsi/initiatorname.iscsi

# 重启 iscsid 服务,释放之前客户端扫描时使用的IQN。

[root@iscsi-client ~]# systemctl restart iscsid

# 重新登录

[root@iscsi-client ~]# iscsiadm -m node -T iqn.2026-04.cloud.s.iscsiserver:disk1 -l

多路径访问

服务端准备

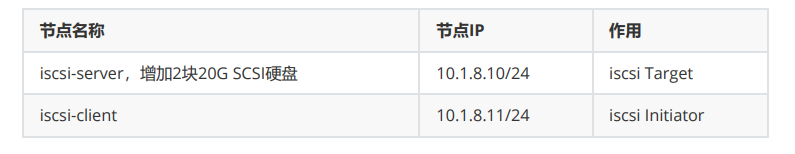

节点规划

环境准备:

[root@iscsi-server ~]#

yum install -y targetd targetcli

systemctl enable target --now

firewall-cmd --permanent --add-service=iscsi-target

firewall-cmd --reload

targetcli /backstores/block create myblock1 /dev/sdb

targetcli /iscsi create iqn.2026-04.cloud.s.iscsi-server:disk1

targetcli /iscsi/iqn.2026-04.cloud.s.iscsi-server:disk1/tpg1/luns create

/backstores/block/myblock1

targetcli /iscsi/iqn.2026-04.cloud.s.iscsi-server:disk1/tpg1/acls create

iqn.2026-04.cloud.s.iscsi-client

targetcli /iscsi/iqn.2026-04.cloud.s.iscsi-server:disk1/tpg1/portals delete

0.0.0.0 3260

targetcli /iscsi/iqn.2026-04.cloud.s.iscsi-server:disk1/tpg1/portals create

10.1.8.10 3260

targetcli /iscsi/iqn.2026-04.cloud.s.iscsi-server:disk1/tpg1/portals create

10.1.1.10 3260

targetcli saveconfig

#验证

[root@iscsi-server ~]# targetcli /iscsi/iqn.2026-04.cloud.s.iscsiserver:disk1/tpg1/portals ls

o- portals ........................................................... [Portals:

2]

o- 10.1.1.10:3260 ..........................................................

[OK]

o- 10.1.8.10:3260 ..........................................................

[OK]

[root@iscsi-server ~]#

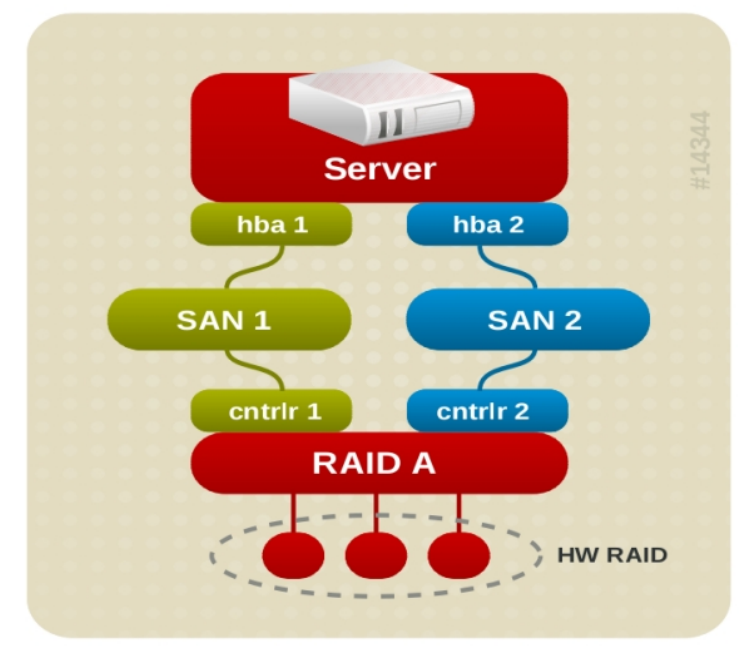

什么是多路径

多路径是指服务器和存储阵列存在多个物理连接方式使用虚拟设备,这种方式可以提供更加弹性的存储

连接(一个路径down掉不会影响连接性),也可以聚合存储带宽提供性能。

示例:

多路径由dm-multipath子系统提供,使用内核device mapper系统获得虚拟设备,有multipathd进程和

multipath命令行工具管理。

软件包device-mapper-multipath提供必要的binaries daemon和kernel modules。安装、配置、启动

后,多路径设备节点会创建在两个位置。

出于管理目的,multipath设备创建在/dev/mapper,如果选择了user-friendly名称,这些设备也可以命

名为mpathN[pM],或者配置在World Wide ID(WWID)之后。管理员也可以自定义多路径设备名,这

些自定义名称在multipaths配置文件的multipaths部分使用alias选项定义。

多路径设备也会创建在/dev目录,格式/dev/dm-N与/dev/mapper下的文件匹配。这些设备提供给系统

内部使用,禁止管理目的直接使用。

重要:多路径提供存储访问路径down情况的保护。如果存储本身不可用,访问访问存储也会不可用。

创建多路径设备,不同的路径将会合并到组中,取决于/etc/multipath.conf配置。典型情况,同一时刻

只能激活一个组,一个组可以包含多个路径。当某个组故障,多路径进程将切换流量到不同组中。

配置多路径

安装软件包

[root@iscsi-client ~]# yum install -y device-mapper-multipath

启用多路径

创建配置文件 /etc/multipath.conf 最简单的方法是使用mpathconf工具:

- 如果文件不存在,使用以下命令生成配置文件。也可以从默认位置/usr/share/doc/device-mappermultipath-*/multipath.conf拷贝过来。

[root@iscsi-client ~]# mpathconf --enable

- 如果文件已经存在,则以下命令会修改文件配置。

[root@iscsi-client ~]# mpathconf --enable --with_multipathd y --with_chkconfig y

编辑配置文件后,使用 systemctl 命令 enable 和 start multipathd 进程。

[root@iscsi-client ~]# systemctl enable multipathd --now

发现设备

[root@iscsi-client ~]# vim /etc/iscsi/initiatorname.iscsi

InitiatorName=iqn.2026-04.cloud.s.iscsi-client

[root@iscsi-client ~]# iscsiadm -m discovery -t st -p 10.1.8.10

10.1.8.10:3260,1 iqn.2026-04.cloud.s.iscsi-server:disk1

10.1.1.10:3260,1 iqn.2026-04.cloud.s.iscsi-server:disk1

[root@iscsi-client ~]# iscsiadm -m node -L all

确定设备是同一设备

WWN(World Wide Name),全球唯一名称,是由 IEEE 标准化的全球唯一标识符,用于标识存储设

备(如硬盘、RAID 阵列、光纤交换机等),每个设备具有全球唯一名称。

应用场景:在光纤通道(FC)、iSCSI 等存储网络中,用于识别和定位存储设备。

WWN 是判断多路径设备是否指向同一存储设备的 核心依据:所有属于同一多路径设备的物理路径(如

sdb 、 sdc ),其对应的存储设备 WWN 必然相同。

scsi_id 命令

[root@iscsi-client ~]# /usr/lib/udev/scsi_id -g -u /dev/sdb

360014059a4a72ad3bf84b9bbb2ec0ffb

[root@iscsi-client ~]# /usr/lib/udev/scsi_id -g -u /dev/sdc

360014059a4a72ad3bf84b9bbb2ec0ffb

udevadm 命令

[root@iscsi-client ~]# udevadm info --query=property --name=/dev/sdb | grep

ID_WWN_W

ID_WWN_WITH_EXTENSION=0x60014059a4a72ad3bf84b9bbb2ec0ffb

[root@iscsi-client ~]# udevadm info --query=property --name=/dev/sdc | grep

ID_WWN_W

ID_WWN_WITH_EXTENSION=0x60014059a4a72ad3bf84b9bbb2ec0ffb

通过 UUID 或其他标识符辅助判断

[root@iscsi-client ~]# blkid /dev/sdb

[root@iscsi-client ~]# blkid /dev/sdc

监控多路径

multipath命令也可用于多路径状态监控。

- -l 选项,显示多路径拓扑简介。

- -ll 选项,会检测所有路径是否active,如果没有问题,路径的状态为active和ready。命令输出还会

包括每个多路径设备的信息,有三个部分组成:多路径设备,path group,path group成员。

示例:

[root@iscsi-client ~]# multipath -ll

mpatha (360014059a4a72ad3bf84b9bbb2ec0ffb) dm-3 LIO-ORG ,myblock1

size=20G features='0' hwhandler='0' wp=rw

|-+- policy='service-time 0' prio=1 status=active

| `- 3:0:0:0 sdb 8:16 active ready running

`-+- policy='service-time 0' prio=1 status=enabled

`- 4:0:0:0 sdc 8:32 active ready running

status=active → 当前活动路径、主路径 sdb 是主路径(当前 I/O 走这条)

status=enabled → 备用可用路径、从路径 sdc 是备路径(冗余备用)

默认策略 service-time 0 ,属于:主备模式(Active-Passive)

- 同一时间只走一条主路径

- 主路径断了,自动切到 sdc

- 平时 sdc 闲着,不跑流量

配置文件

配置文件 /etc/multipath.conf,包含5个部分:

- defaults,定义了所有多路径的默认配置,会被devices和multipaths块配置覆盖。

- blacklist,定义了多路径设备中不允许使用的设备。

- blacklist_exceptions,定义了多路径设备中应该包含的设备,即使设备已经定义在blacklist中。

- devices,指定特定设备类型,会被multipaths块覆盖。device是通过他们的vendor product和

- revision(修正)关键字识别(来自于sysfs的正则表达式匹配)。

- multipaths,包含指定路径,会覆盖defaults块和devices块中定义的设备。多路径基于他们的

- WWIDs识别(使用getuid_callout函数获得)

覆盖方式:multipaths > devices > defaults。

使用设备

多路径设备名称为 /dev/mapper/mpatha,识别到设备后就可以正常使用。

示例:格式化,挂载。

[root@iscsi-client ~]# mkdir /mpatha

[root@iscsi-client ~]# mount /dev/mapper/mpatha /mpatha

[root@iscsi-client ~]# df -h /mpatha/

Filesystem Size Used Avail Use% Mounted on

/dev/mapper/mpatha 20G 33M 20G 1% /mpatha

持久化挂载

[root@iscsi-client ~]# vim /etc/fstab

# 最后增加一条

/dev/mapper/mpatha /mpatha xfs _netdev 0 0

[root@iscsi-client ~]# systemctl daemon-reload

[root@iscsi-client ~]# umount /mpatha

[root@iscsi-client ~]# mount -a

[root@iscsi-client ~]# df -h /mpatha

Filesystem Size Used Avail Use% Mounted on

/dev/mapper/mpatha 20G 33M 20G 1% /mpatha

高可用性测试

测试1:断开iscsi-server端第二块网卡

[root@iscsi-server ~]# nmcli device disconnect ens36

Device 'ens36' successfully disconnected.xxxxxxxxxx [root@iscsi-server ~]# nmcli

device disconnect ens36Device 'ens36' successfully disconnected.[root@storage ~]#

nmcli device disconnect ens192

以下显示了passive状态的path group发生了故障。active状态的path group保持不变。

[root@iscsi-client ~]# multipath -ll

mpatha (360014059a4a72ad3bf84b9bbb2ec0ffb) dm-3 LIO-ORG ,myblock1

size=20G features='0' hwhandler='0' wp=rw

|-+- policy='service-time 0' prio=1 status=active

| `- 3:0:0:0 sdb 8:16 active ready running

`-+- policy='service-time 0' prio=0 status=enabled

`- 4:0:0:0 sdc 8:32 failed faulty running

测试2:恢复iscsi-server端第二块网卡,断开第一块网卡

以下显示了active状态的path group发生了故障。active状态的path group变更为failed faulty

running,同时状态由active变更为enabled。passive状态的path group变更为active ready running,

同时状态由enabled变更为active。

[root@iscsi-client ~]# multipath -ll

mpatha (360014059a4a72ad3bf84b9bbb2ec0ffb) dm-3 LIO-ORG ,myblock1

size=20G features='0' hwhandler='0' wp=rw

|-+- policy='service-time 0' prio=0 status=enabled

| `- 3:0:0:0 sdb 8:16 failed faulty running

`-+- policy='service-time 0' prio=1 status=active

`- 4:0:0:0 sdc 8:32 active ready running

重要:故障路径恢复后,当前的active path保持不变,即使恢复的路径之前是active path,可以通过手

动切换回来。

openEuler 是由开放原子开源基金会孵化的全场景开源操作系统项目,面向数字基础设施四大核心场景(服务器、云计算、边缘计算、嵌入式),全面支持 ARM、x86、RISC-V、loongArch、PowerPC、SW-64 等多样性计算架构

更多推荐

已为社区贡献3条内容

已为社区贡献3条内容

所有评论(0)