【论文精读】AgentBench:第一个系统评测 LLM 当 Agent 的基准 | 清华 ICLR 2024

清华大学KEG团队开发的AgentBench首次系统性评估了大语言模型作为智能代理的能力。该框架通过8个真实环境(包括操作系统、数据库、游戏等)测试25个主流模型,揭示出:1)商业模型(如GPT-4)显著优于开源模型;2)对话能力与代理能力存在巨大差距;3)长程推理和指令遵循是核心瓶颈;4)不同任务需要差异化能力。研究证明当前LLMs在复杂任务中仍存在明显局限,为AI代理开发提供了重要基准。该成果

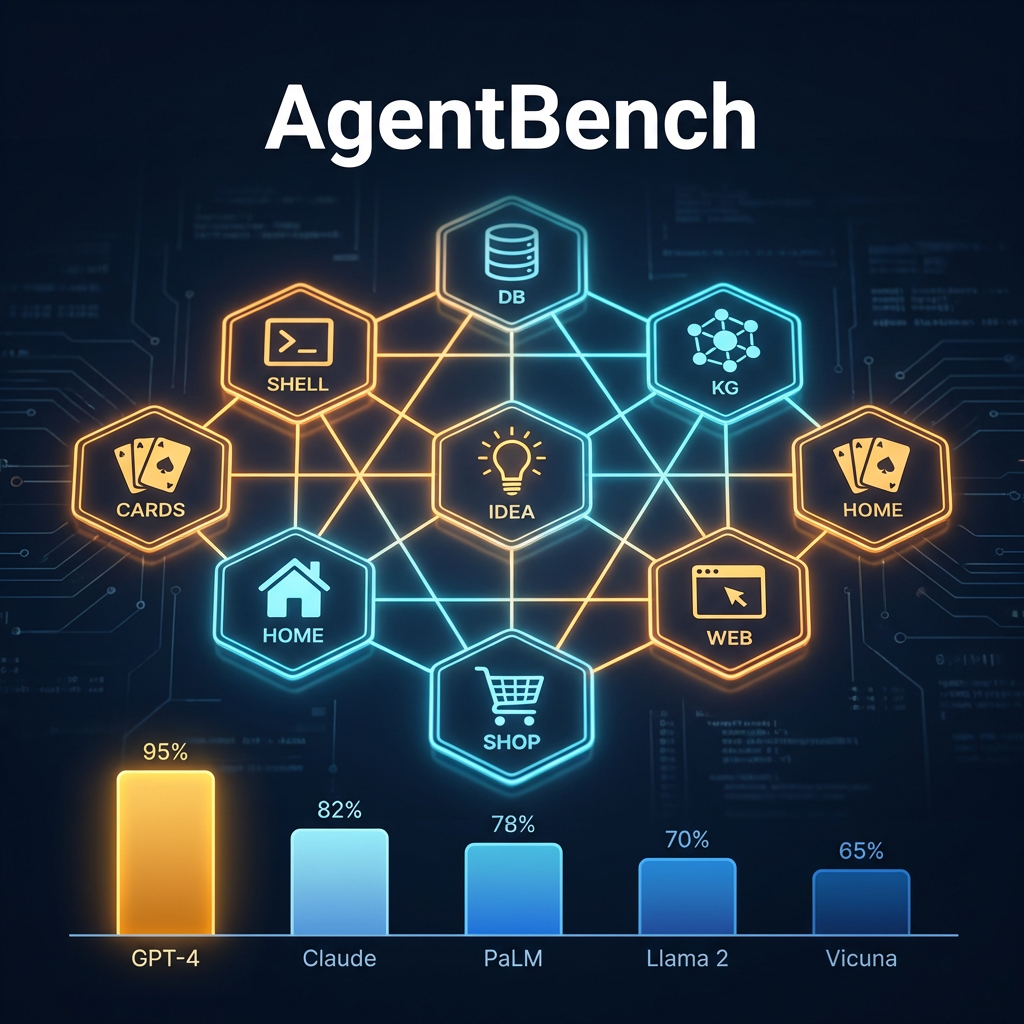

一句话总结:AgentBench 用 8 个真实环境、测试 25 个模型,首次用数据证明——会聊天 ≠ 会做事,GPT-4 一骑绝尘,大部分开源模型连 1 分都拿不到。

论文信息

| 字段 | 内容 |

|---|---|

| 论文标题 | AgentBench: Evaluating LLMs as Agents |

| 机构 | 清华大学 KEG 数据挖掘团队 |

| arXiv | 2308.03688 |

| 发表 | ICLR 2024 |

| GitHub | github.com/THUDM/AgentBench |

一、背景:为什么需要 AgentBench?

大语言模型(LLM)在问答、推理、代码生成上表现越来越好,但真正的 Agent 场景——在复杂环境中自主完成多步任务——却从未有过系统性的评测框架。

AgentBench 的出现填补了这个空白。它不是一道单选题,而是8 个真实"考场",让 25 个主流大模型接受全面测试。

二、核心方法论:8 环境 × 3 分类

AgentBench 将评测环境分为三大类,共 8 个环境:

2.1 代码环境(Code-Grounded)— 操作真实系统

| 环境 | 任务描述 | 核心考察 |

|---|---|---|

| 操作系统 (OS) | 在 Ubuntu Docker 中执行文件操作、用户管理 | 命令行操作、系统理解 |

| 数据库 (DB) | 通过 SQL 操作多表数据库 | SQL 生成、数据推理 |

| 知识图谱 (KG) | 查询 Freebase 知识图谱 | 规划、工具使用 |

2.2 游戏环境(Game-Based)— 策略与推理

| 环境 | 任务描述 | 核心考察 |

|---|---|---|

| 卡牌游戏 (DCG) | Aquawar 回合制策略卡牌(清华自研) | 策略制定、动态调整 |

| 横向思维 (LTP) | 海龟汤式问答推理 | 发散思维、创造性推理 |

| 家庭环境 (ALF) | 在模拟家中找东西、搬东西(基于 AlfWorld) | 常识规划执行 |

2.3 网络环境(Web-Based)— 在线交互

| 环境 | 任务描述 | 核心考察 |

|---|---|---|

| 网络购物 (WS) | 在模拟电商搜索购买商品 | 搜索决策、信息筛选 |

| 网页浏览 (M2W) | 在真实网站执行复杂操作 | 网页理解、操作规划 |

设计哲学:5 个新建环境 + 3 个重新编译的经典环境,覆盖"代码 → 游戏 → 网络"三层递进。

三、25 个模型的测试结果

3.1 完整排名(部分)

| 排名 | 模型 | 总评分 | OS | DB | KG | DCG | LTP | ALF | WS | M2W |

|---|---|---|---|---|---|---|---|---|---|---|

| 1 | GPT-4 | 4.41 | 36.83 | 33.75 | 21.50 | 0.01 | 7.67 | 8.05 | 8.62 | 2.60 |

| 2 | Claude | 2.77 | 13.21 | 16.83 | 6.23 | 0.01 | 0.45 | 2.05 | 9.32 | 1.00 |

| 3 | GPT-3.5-turbo | 2.55 | 32.61 | 5.02 | 7.23 | 0.00 | 0.05 | 2.05 | 9.32 | 1.00 |

| 8 | chatglm2(最佳开源) | 1.31 | 14.61 | 3.76 | 6.83 | 0.01 | 2.66 | 6.06 | 1.94 | 2.92 |

| 25 | oasst-pythia-12b | 0.07 | 2.81 | 0.00 | 0.00 | 0.00 | 1.52 | 0.00 | 0.01 | 0.33 |

3.2 梯队分析

| 梯队 | 代表模型 | 分数范围 | 特征 |

|---|---|---|---|

| S 梯队 | GPT-4 | 4.41 | 一骑绝尘,多项第一 |

| A 梯队 | Claude、GPT-3.5 | 2.5~2.8 | 能用但有明显短板 |

| B 梯队 | davinci 系列 | 1.4~2.1 | 部分场景可用 |

| C 梯队 | chatglm2、openchat | 1.0~1.4 | 开源最强,整体弱 |

| D 梯队 | 其余开源模型 | <1.0 | 几乎不可用 |

四、6 大关键发现

发现 1:商业模型 vs 开源模型,鸿沟巨大

GPT-4(4.41)vs 最佳开源 chatglm2(1.31)→ 3.37 倍差距。

在 2023 年,想用 Agent 做事,商业 API 几乎是唯一选择。

发现 2:会聊天 ≠ 会做事 ⭐ 最核心结论

很多模型在问答/对话上表现不错,但在 AgentBench 中"做事"极差。传统 NLP 能力(QA、推理、摘要)无法预测 Agent 能力。

评估 Agent 必须用"实战"环境,不能只看对话能力。

发现 3:长程推理是最大障碍

开源模型失败的核心原因:无法维持多步推理的连贯性。

表现为:第 3~4 步开始偏离目标,后续越来越混乱。Agent 的核心不是"知道答案",而是"知道下一步该做什么"。

发现 4:指令遵循决定上限

能准确理解并执行复杂指令的模型,Agent 表现显著更好。改进方向是高质量多轮对齐数据训练。

对数字员工来说,"听得懂话"比"知识丰富"更重要。

发现 5:代码训练的矛盾效果

代码训练在 OS/DB 环境有益,但在游戏/购物环境可能有损。不存在"万能训练方法",Agent 能力是多维的。

发现 6:卡牌游戏是"众神黄昏"

DCG(卡牌游戏)几乎所有模型得分 ≈ 0,包括 GPT-4 也只有 0.01 分。复杂博弈和策略规划仍是当前 LLM 的天花板。

五、AgentBench 的历史地位

AgentBench 是 Agent 评测领域的开山之作(2023.08),它的价值在于:

- 定义了问题:把"LLM 能不能做 Agent"从定性讨论变成定量评测

- 建立了方法论:多环境×多模型的系统评测范式,SWE-bench、HAL、GAIA 等后续工作都在此基础上发展

- 揭示了鸿沟:首次用数据证明商业模型 vs 开源模型在 Agent 能力上的巨大差距,推动了开源社区加速追赶

- 提供了基础设施:开源的评测框架成为后续研究的标准工具

但它也有局限:

- ❌ 每个环境只跑一次,不测可靠性(HAL 后来专门补充)

- ❌ 2023 年数据,模型已大幅迭代

- ❌ 不评估一致性/鲁棒性

六、给 AI 工程师的启示

如果你在构建或评估 AI Agent 系统,AgentBench 的三个启示值得铭记:

1. 多维测试,不要只看问答分数

MMLU、C-Eval 这类通用评测无法反映 Agent 的真实能力。想知道你的模型/系统能不能用,必须放到真实任务场景里测。

2. 关注失败模式,不只是成功率

AgentBench 不只给分,还分析"为什么失败"(10 类失败原因)。失败归因比通过率更有价值——它告诉你下一步该改什么。

3. 能力是多维的,警惕单一指标

代码训练提升了 OS/DB 能力,却可能损害游戏能力。没有"万能优化方法",构建 Agent 系统需要为目标场景单独设计和测试。

总结

AgentBench 用一句话说清楚了 2023 年 LLM 的 Agent 现状:

GPT-4 是班里的学霸,开源模型是等待觉醒的追赶者,而"博弈"这道题,全班都还不会答。

两年后的今天(2025~2026),开源模型已大幅追赶,但 AgentBench 揭示的核心规律——长程推理能力、指令遵循质量决定 Agent 上限——依然是构建 AI Agent 系统的第一原则。

参考资料

- 论文:AgentBench: Evaluating LLMs as Agents (arXiv 2308.03688)

- GitHub:github.com/THUDM/AgentBench

- 排行榜:llmbench.ai/agent

作者:路易乔布斯 | 系列:AI Agent 评测七日研读

openEuler 是由开放原子开源基金会孵化的全场景开源操作系统项目,面向数字基础设施四大核心场景(服务器、云计算、边缘计算、嵌入式),全面支持 ARM、x86、RISC-V、loongArch、PowerPC、SW-64 等多样性计算架构

更多推荐

已为社区贡献3条内容

已为社区贡献3条内容

所有评论(0)