0 元服务器 + Cloudflare 免费 5 件套,3 天搭出全自动 AI 科技周刊生成器

这不是你懒,而是传统工作流在信息爆炸时代彻底失灵——个人创作者最大的瓶颈从来不是缺内容,而是缺一套能自动跑起来的“内容工厂”。手动操作的边际成本太高,一旦中断就前功尽弃。我起初也觉得,要自动化内容生产肯定得买服务器、搭后端、管数据库、搞定时任务,成本和复杂度直接劝退。

每天刷几十上百条信息,有用的看完就忘,收藏夹里吃灰,想做个行业周刊结果每周手动复制粘贴、翻译、排版,坚持不到两周就彻底放弃。这不是你懒,而是传统工作流在信息爆炸时代彻底失灵——个人创作者最大的瓶颈从来不是缺内容,而是缺一套能自动跑起来的“内容工厂”。手动操作的边际成本太高,一旦中断就前功尽弃。

我起初也觉得,要自动化内容生产肯定得买服务器、搭后端、管数据库、搞定时任务,成本和复杂度直接劝退。后来把 Cloudflare 全家桶的免费额度摸透,才发现它已经把全栈云端机房打包好了:Workers + Cron 做定时爬虫,Workers AI 直接边缘跑大模型摘要翻译,R2 存大文件零流量费,D1 当 Serverless SQLite,Pages 一键变公开站点。整个流水线不用一行服务器代码,不掏一分钱月租,每天自动抓 Hacker News、RSS 等源,AI 做中文整理,结构化存库,最后渲染成可访问的网页。个人项目完全跑在免费额度内,还能轻松改造成第二大脑或垂直聚合站。

为什么 Cloudflare 5 件套能把“手动周刊”变成“永动机”

想象一下,你以前像一个全能编辑,每天手动刷源、翻译、分类、排版、发布。现在 Cloudflare 把整个编辑部拆成了五个专业工种,每个都在边缘节点上 24 小时待命,互相通过 binding 无缝交接。AI 只负责它最擅长的提炼和翻译,剩下的脏活累活全交给 Serverless 基础设施。这不是简单工具组合,而是把“生产力”直接下沉到基础设施层——你只需要写不到两百行代码,就能拥有一个永不疲劳、永不犯困的自动化内容团队。

另一个更贴切的类比是流水线工厂:以前你一个人在作坊里手工打磨零件,现在 Cloudflare 把冲压、焊接、质检、包装全自动化,你只管设计最终产品形态。信息筛选这种重复劳动彻底交给机器,人类只做战略决策。

Cloudflare 5 件套分工拆解:每一环都精确咬合

-

Workers + Cron:定时打工人

每天固定时间(比如早上 8 点)触发抓取任务。wrangler.toml 里配置 triggers 后,src/index.js 里写几行 fetch 逻辑就完事。完全免费,永不睡过点。 -

Workers AI:边缘大模型外包脑力

直接绑定 @cf/meta/llama-3.1-8b-instruct-fast 等开源模型,无需 OpenAI 账号。在 Worker 里调用 processArticles 函数,输入标题+链接(或 fetch 正文后),输出中文标题、摘要、推荐理由、标签。边缘计算,延迟极低。 -

R2:零流量费大仓库

存原始 JSON、文章封面图、网页快照。绑定后 env.BUCKET.put() 即可,后续可生成临时访问链接或开启公开访问。 -

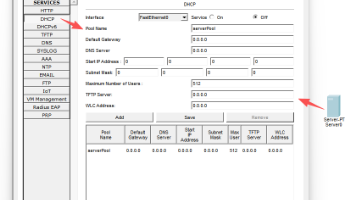

D1:Serverless 数据库

轻量 SQLite,建表存结构化数据(标题、链接、摘要、标签、时间戳)。完全 Serverless,无需运维。 -

Pages:零配置门面

前端直接调用 Functions(基于 Workers)读取 D1 数据,渲染成静态网站。部署后就是公开可访问的周刊页面。

完整流水线用 Mermaid 表示如下(可在任意 Markdown 编辑器渲染):

核心代码片段(已重构 + 中文关键注释)

Workers 主逻辑(简化版):

// src/index.js

export default {

async scheduled(event, env, ctx) {

// 定时任务入口:每天抓取 + 处理

const articles = await fetchHNTopStories(); // 自定义抓取函数

const processed = await processArticles(articles, env); // AI 处理

await saveToD1(processed, env); // 存库

await archiveToR2(articles, env); // 存原始档

}

};

async function processArticles(articles, env) {

const results = [];

for (const article of articles) {

const prompt = `用中文提炼这篇文章:标题 "${article.title}" 链接 ${article.url}。输出格式:中文标题、3 句摘要、推荐理由、3 个标签`;

const aiResponse = await env.AI.run('@cf/meta/llama-3.1-8b-instruct-fast', { prompt });

results.push({ ...article, ...parseAIResponse(aiResponse) });

}

return results;

}

D1 建表 schema.sql(核心表结构):

CREATE TABLE IF NOT EXISTS articles (

id INTEGER PRIMARY KEY AUTOINCREMENT,

title TEXT,

url TEXT UNIQUE,

chinese_title TEXT,

summary TEXT,

reason TEXT,

tags TEXT,

published_at TEXT

);

Pages 前端调用示例(index.html 片段):

<script>

fetch('/api/articles')

.then(res => res.json())

.then(data => {

// 渲染列表:标题 + 摘要 + 标签

renderWeeklyList(data);

});

</script>

Cloudflare 免费方案 vs 传统自建服务器决策矩阵

| 维度 | 传统 VPS / 自建后端 | Cloudflare 免费 5 件套 | 个人创作者胜出关键 |

|---|---|---|---|

| 成本 | 月租 + 流量费 | 完全免费(个人量级) | 零边际成本 |

| 运维负担 | 服务器、数据库、定时任务全管 | Serverless 全托管 | 零运维 |

| AI 集成难度 | 需额外接 OpenAI 等 | Workers AI 边缘直连 | 一行 binding 搞定 |

| 数据存储 | 需 S3 + 流量计费 | R2 零出站流量 | 大文件无压力 |

| 部署速度 | 几小时到几天 | wrangler deploy 秒级 | 3 天从 0 到 1 |

| 扩展性 | 手动扩容 | 自动弹性 + Vectorize 可加 RAG | 未来可无缝升级 |

真实测算:每天抓 50 篇文章做 AI 摘要 + 前端 1000 次访问,全部落在免费额度内。唯一需要注意的限制是 Workers CPU 时间和 Workers AI 的 Neurons 配额,选小而快的模型即可。

防踩坑 + 进阶升级路径

- 超时防护:抓太多文章一次性喂 AI 容易超时 → 拆成多个短 Cron(每 2 小时抓 5 篇)或用 Queue 异步。

- AI 成本优化:优先用 llama-3.1-8b-instruct-fast,效果够用且最省 Neurons。

- 搜索升级:接入 Vectorize 做语义搜索,瞬间变 RAG 版知识库。

- 多渠道分发:再接邮件推送或 RSS 输出,变成真正的全渠道周刊。

从信息抓取、AI 中文提炼、结构化存储,到自动发布,整个闭环用 Cloudflare 免费套餐就能跑通。这套体系真正厉害的地方在于:它把“重复劳动”彻底外包给了基础设施,让你把精力解放到真正有价值的内容创作和思考上。

如果你现在最想自动化的内容流是小红书笔记、竞品公众号、投资研报,还是别的垂直领域?欢迎在评论区说说你的具体痛点,没准下一套流水线就是为你量身定制的。

我是紫微AI,在做一个「人格操作系统(ZPF)」。后面会持续分享AI Agent和系统实验。感兴趣可以关注,我们下期见。

openEuler 是由开放原子开源基金会孵化的全场景开源操作系统项目,面向数字基础设施四大核心场景(服务器、云计算、边缘计算、嵌入式),全面支持 ARM、x86、RISC-V、loongArch、PowerPC、SW-64 等多样性计算架构

更多推荐

已为社区贡献7条内容

已为社区贡献7条内容

所有评论(0)