某集团企业智能体(Agent)操作系统(AOS)基础平台与企业级Agent治理体系详细设计方案(WORD)

先用一个类比来建立直觉。手机操作系统(iOS/Android)的存在价值是什么?不是为了让手机"更智能",而是为了给所有应用提供统一的运行环境——统一的权限管理、统一的资源调度、统一的进程隔离、统一的消息通信。有了这层,开发者才能专注于应用逻辑,而不是每次都重新解决蓝牙驱动或内存分配的问题。AOS(Agent Operating System)做的是同一件事,只是对象从App变成了Agent。

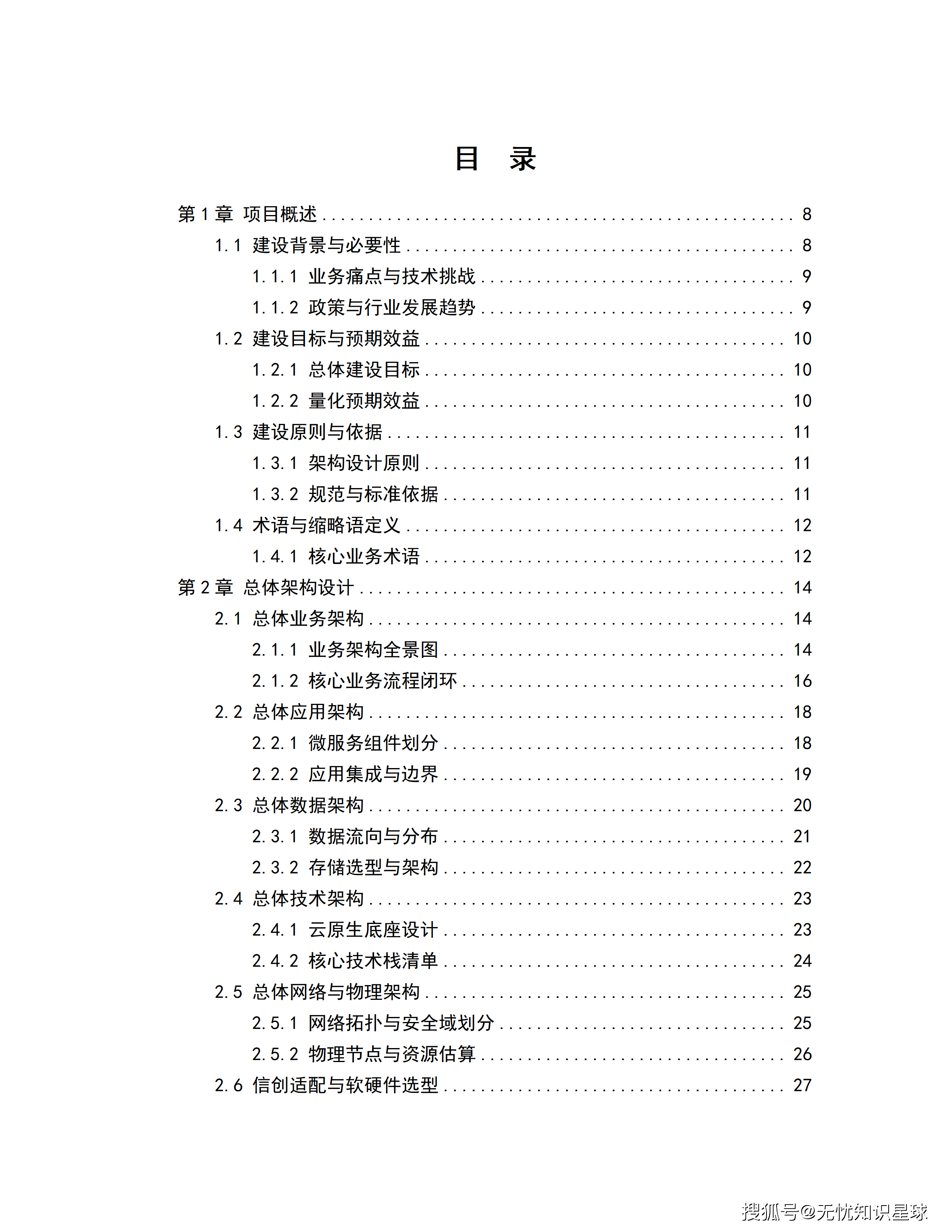

导读 :随着大模型技术深入业务场景,企业内部Agent数量激增,面临管理碎片化、安全合规难及资源调度低效等挑战,亟需构建统一的治理底座。本项目旨在建设企业级智能体操作系统(AOS),核心内容涵盖Agent注册发现、统一调度引擎及沙箱隔离执行环境,并配套完善的权限管控、Tool调用安全及全生命周期管理体系。通过集成可观测性监控,实现对Agent运行状态的实时把控。预期目标是打造标准化、安全可控的Agent运行与治理平台,降低开发运维成本,保障企业AI应用的高效落地与持续演进。

一、问题从哪里来:企业Agent的"烟囱式"困境

先说一个在大型集团里极为普遍的现象。

信息技术部和战略部各自引入了Agent能力。信息技术部用LangChain框架接了一套运维自动化Agent,战略部用AutoGPT搭了一套市场分析Agent,某业务线自己找了一家AI厂商做了一套客户服务Agent。三套系统,三套框架,三套鉴权逻辑,三份大模型API账单。

这三套系统之间,没有任何协调机制。

这不是假设,而是2024年到2025年间绝大多数头部企业的真实状态。

问题出在哪里?

第一个问题:重复建设,效率极低。 每个团队都在独立解决同一批底层问题——模型接入、Prompt管理、记忆机制、工具调用协议。一家500人的技术部门,可能有三个团队各自实现了一遍LLM的重试逻辑。这些精力本可以用在业务价值的创造上。

第二个问题:安全盲区,风险无人管。 Agent调用ERP的时候,用的是什么权限?有没有人审计它读了哪些字段?写操作有没有二次确认?在大多数现有实现里,答案是:没有。Agent对接核心生产系统,采用的是点对点硬编码的API调用,既没有统一鉴权,也没有操作留痕。这是典型的"影子IT"风险,只是换成了"影子AI"。

第三个问题:成本黑洞,无从归因。 大模型按Token计费,多个业务部门各自采购、各自消耗,集团层面既看不清整体的Token消耗情况,也无法按业务价值进行合理分摊。哪个Agent消耗最多?哪个业务场景ROI最高?这些问题在碎片化架构下根本无法回答。

第四个问题:没有可观测性,出了问题不知道从哪里查。 一个Agent给出了错误的财务建议,你能追溯到它调用了哪个工具、使用了哪段记忆、经过了几轮推理吗?在大多数现有架构里,答案是不能。黑盒化运行是当前企业Agent的常态,这在监管要求日益严格的背景下,是一颗随时可能引爆的地雷。

这四个问题合在一起,构成了企业Agent规模化落地的核心阻力。

解法不是继续在每个问题上打补丁,而是从架构层面引入一个统一的治理底座。这就是"智能体操作系统(AOS)"要做的事。

二、AOS是什么:一个比喻和一个定义

先用一个类比来建立直觉。

手机操作系统(iOS/Android)的存在价值是什么?不是为了让手机"更智能",而是为了给所有应用提供统一的运行环境——统一的权限管理、统一的资源调度、统一的进程隔离、统一的消息通信。有了这层,开发者才能专注于应用逻辑,而不是每次都重新解决蓝牙驱动或内存分配的问题。

AOS(Agent Operating System)做的是同一件事,只是对象从App变成了Agent。

一句话定义:AOS是企业内所有Agent的统一运行与治理环境,负责Agent的生命周期管理、跨Agent协同通信、资源调度与安全合规。

它不是一个具体的Agent,也不是一个大模型应用平台。它是运行在所有Agent之下的那一层中间件基础设施。

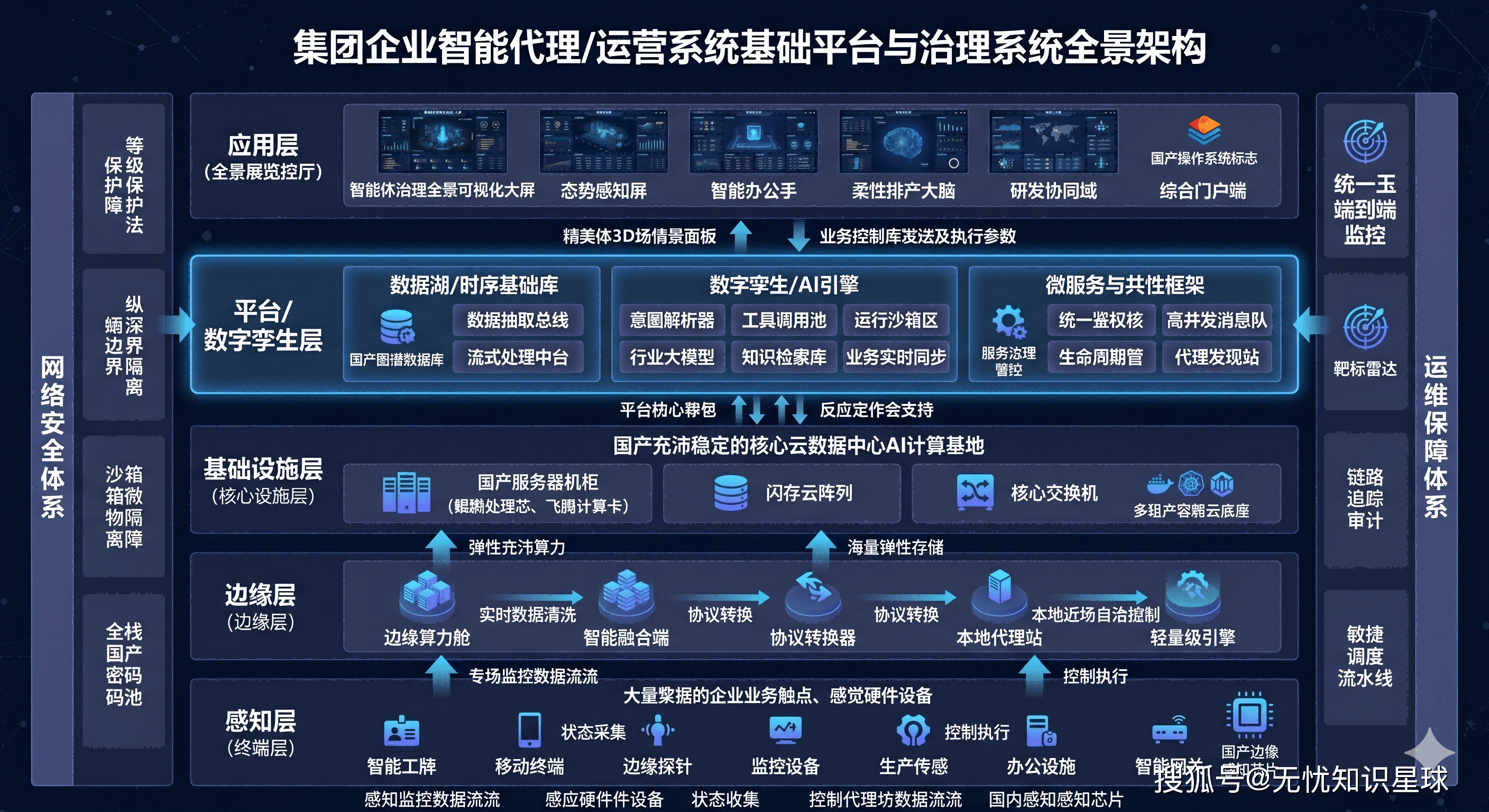

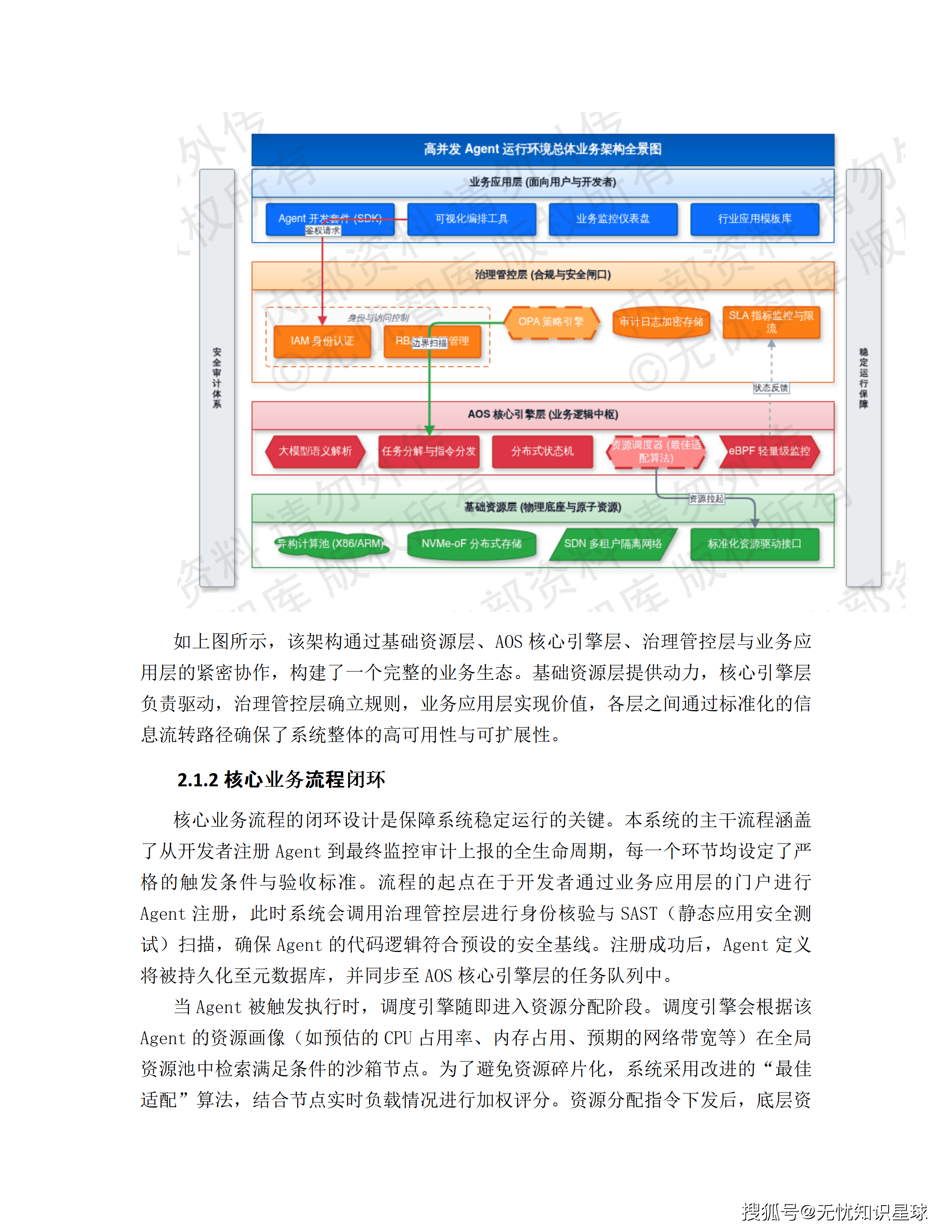

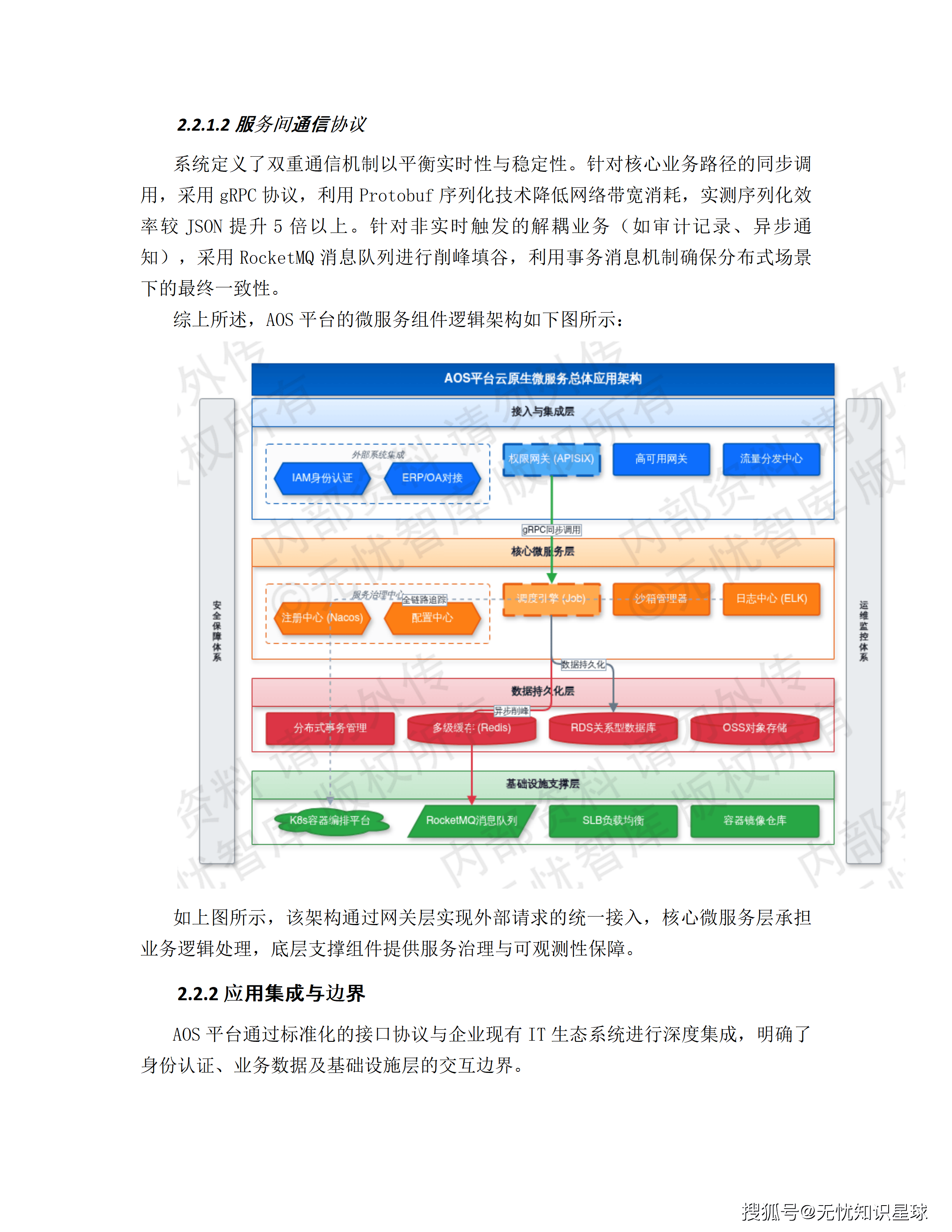

从架构分层来看,整个体系自下而上可以分为四层:

- 基础资源层:算力、存储、网络的物理底座,支持X86与ARM混合调度。

- AOS核心引擎层:负责Agent注册发现、任务调度、沙箱隔离执行,是整套体系的中枢。

- 治理管控层:身份认证、权限控制、审计日志、合规策略,是系统风险防控的闸口。

- 业务应用层:面向开发者和用户的功能入口,包括可视化编排工具、行业应用模板和监控仪表盘。

这四层的分工逻辑很清晰:资源层提供动力,引擎层负责驱动,治理层确立规则,应用层实现价值。每层之间通过标准化API交互,实现业务逻辑与底层资源的物理解耦。

接下来,我们逐一拆解其中最关键的几个组件。

三、Agent注册与发现:给每个智能体一张"身份证"

任何大规模系统的第一个问题,都是:怎么知道这个系统里有哪些实体?

在微服务架构里,这个问题由服务注册中心解决(Nacos、Consul)。在AOS里,对应的是Agent注册与发现中心。

3.1 Agent元数据模型:不只是"我在这里"

Agent注册不只是告诉系统"我在运行",而是提供一份完整的结构化自描述。

元数据模型的核心字段分为四个维度:

身份标识维度:全局唯一的Agent_ID(UUID v4标准)和Namespace字段。Namespace实现多租户环境下的逻辑隔离,不同业务域的Agent互不干扰。这是多部门、多子公司场景下最基础的隔离边界。

能力描述维度:用语义化标签定义Agent的任务领域,比如"代码逻辑生成"、“财务数据分析”、“多模态视觉识别”。同时规定输入输出的数据结构Schema,确保编排引擎能够准确解析Agent的交互接口。

工具依赖维度(Tool_Manifest):详细列出Agent挂载的外部工具集。每个工具项包含API端点、入参校验规则和鉴权模式。这是后续做安全审计和权限管控的基础数据。

资源需求维度(Resource_Quota):声明CPU核心数、内存占用阈值、是否需要GPU算力支持。调度引擎靠这份声明做资源预分配,而不是等Agent跑起来再去抢资源。

这份元数据在注册时经过强Schema校验,通过后持久化至分布式存储,并同步至调度引擎的任务队列。这意味着,一个Agent从第一天上线,它的能力边界、资源需求和工具依赖就是明确可查的。

3.2 心跳检测与状态管理:秒级感知节点存活

Agent是动态的,实例随时可能启停。注册中心需要维护一份实时准确的存活状态视图,否则调度引擎就会把任务分发给不存在的节点。

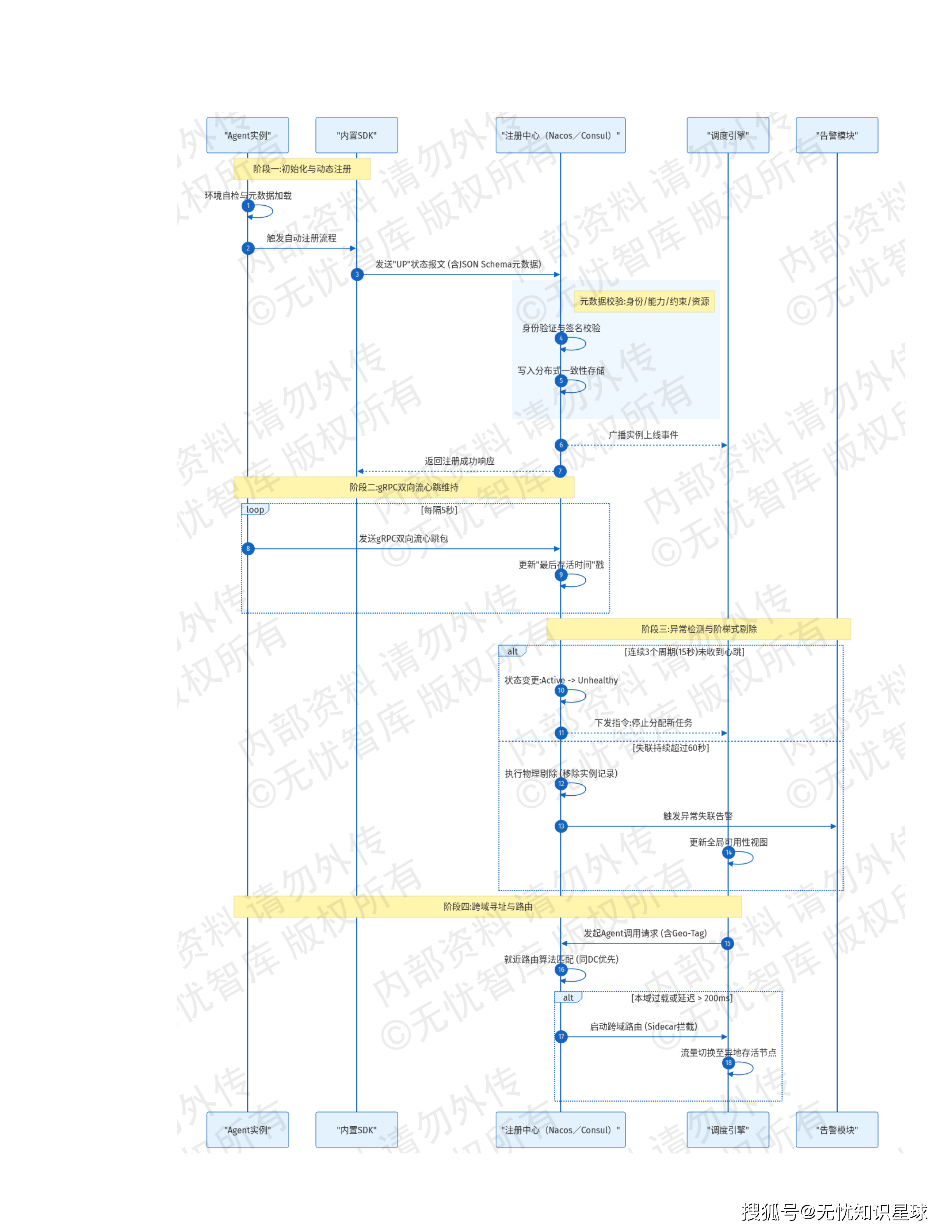

系统采用基于gRPC双向流的秒级心跳机制。相比传统的HTTP短连接轮询,gRPC双向流大幅降低了网络信令开销,状态感知延迟从秒级降至毫秒级。Agent实例每隔5秒发送一次心跳包,注册中心实时更新"最后存活时间"戳。

剔除策略是阶梯式的:

- 连续15秒(3个心跳周期)未收到反馈:标记为"Unhealthy",停止分配新任务。

- 失联超过60秒:执行物理剔除,彻底移除记录,触发运维告警。

这确保了调度引擎始终基于真实的Agent可用性视图做决策,不会把请求打到已下线的实例上。

四、统一调度引擎:让复杂任务有序流转

如果说注册发现中心解决了"知道有谁"的问题,调度引擎解决的就是"知道让谁做什么,以及怎么做"的问题。

这是整套AOS体系里技术密度最高的模块,也是企业级AI应用从"单Agent玩具"迈向"多Agent生产系统"的关键跨越。

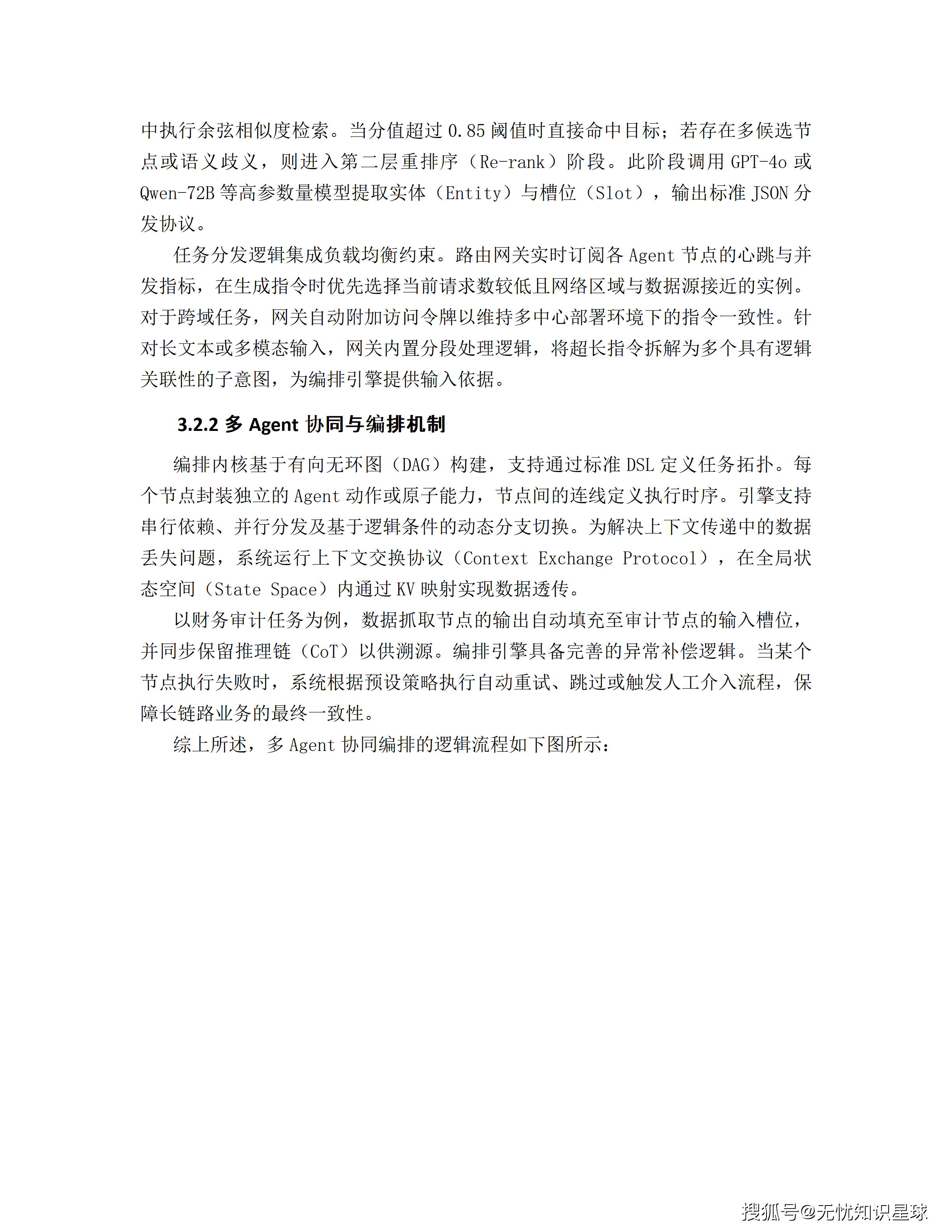

4.1 意图路由:把自然语言翻译成执行协议

用户的一个业务请求,通常是自然语言描述的,比如"帮我分析上个季度的华东区销售数据,生成一份趋势报告并发送给区域经理"。

调度引擎要做的第一件事,是把这句话翻译成结构化的执行指令。

系统部署双层过滤架构:

第一层:用轻量化语义向量模型(BGE-M3等)做初步筛选,在Agent能力向量库中做余弦相似度检索。分值超过0.85直接命中目标Agent;有歧义则进入第二层。

第二层:调用高参数量模型(GPT-4o或国产大模型)做精细的意图解析,提取实体(Entity)和槽位(Slot),输出标准化的JSON分发协议。

路由完成后,网关实时参考各Agent节点的心跳与并发指标,优先将任务路由至当前负载较低、且与数据源地理区域接近的实例。

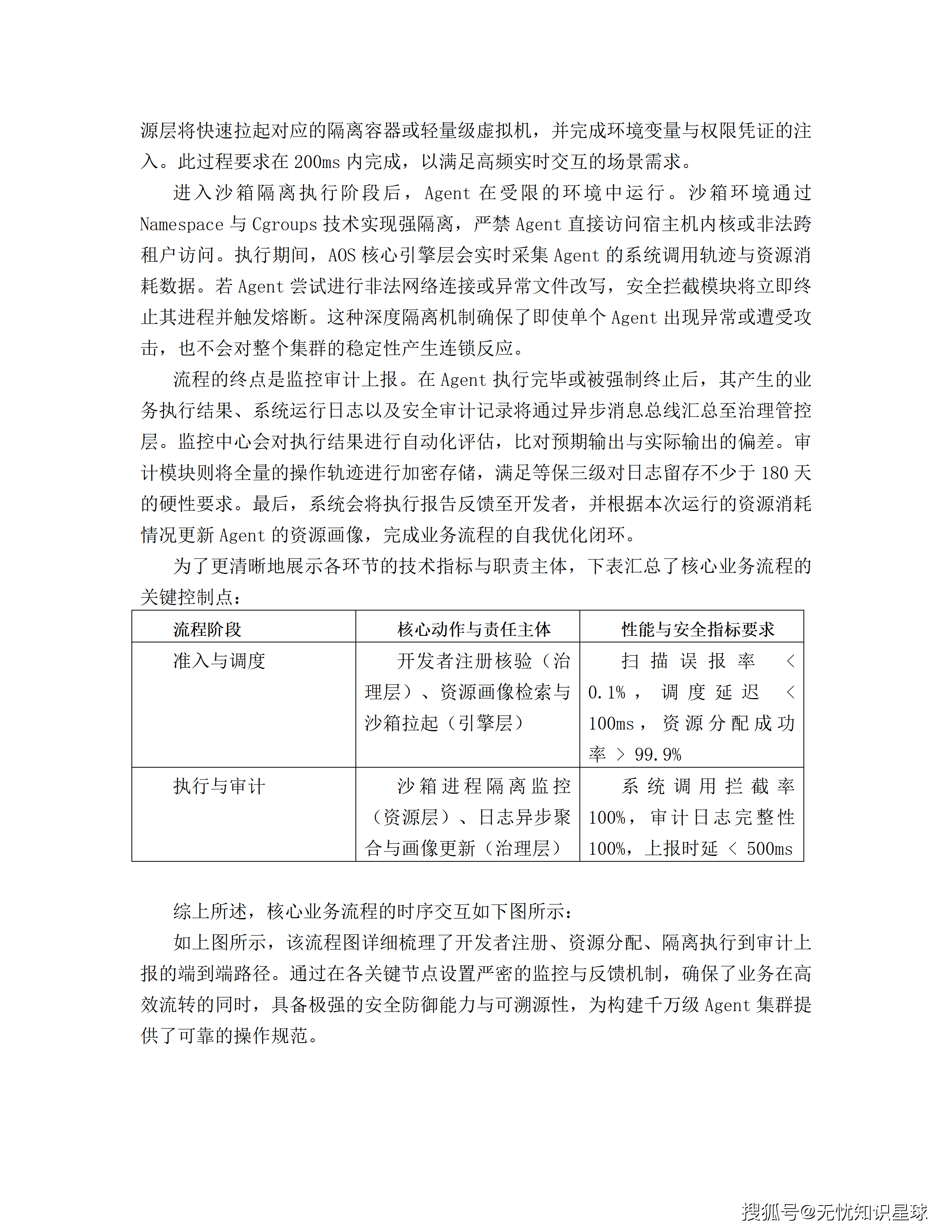

4.2 多Agent协同:DAG编排引擎

很多业务场景不是一个Agent能搞定的。"分析销售数据、生成报告、发送邮件"这个任务,至少涉及三个不同能力的Agent,它们之间有严格的先后依赖关系。

调度引擎的编排内核基于有向无环图(DAG)构建,支持通过标准DSL定义任务拓扑:

- 每个节点封装独立的Agent动作或原子能力。

- 节点间的连线定义执行时序——串行依赖、并行分发、条件分支,都可以通过拓扑结构来表达。

- 上下文交换协议确保节点间的数据透传,数据抓取节点的输出自动填充至分析节点的输入槽位。

当某个节点执行失败时,引擎根据预设策略执行自动重试、跳过或触发人工介入,保障长链路业务的最终一致性。

以财务审计场景为例:数据抓取Agent从ERP拉取原始数据,分析Agent做异常检测,报告生成Agent产出摘要,审计Agent执行合规性核查。四个Agent串联执行,每个节点的输出作为下一个节点的输入,整个过程无需人工干预,且每一步推理链(CoT)都有完整记录可供溯源。

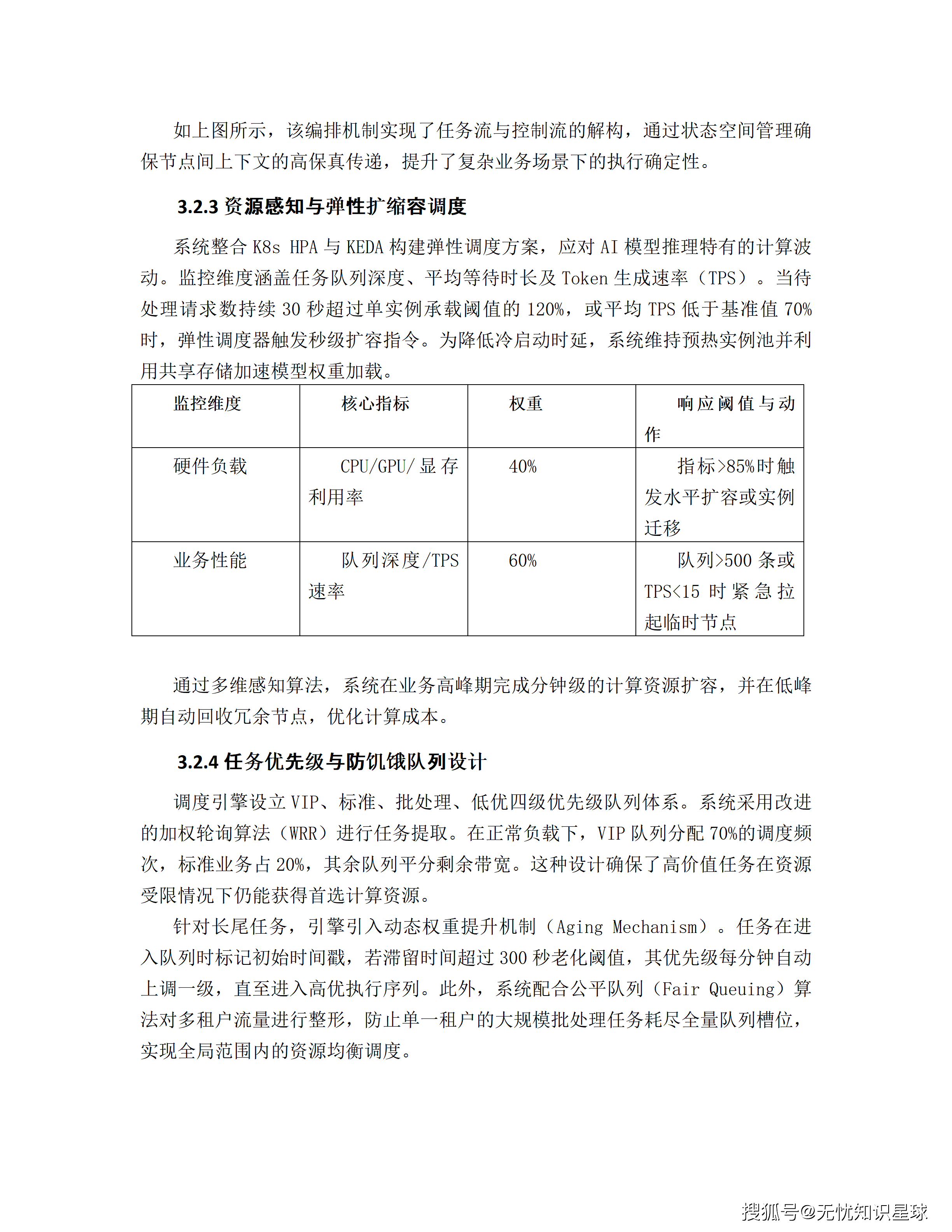

4.3 弹性调度:AI算力的独特挑战

企业AI系统的算力需求有一个特殊之处:峰值与谷值之间的波动极大,而且峰值往往不可预测。

调度引擎整合K8s HPA与KEDA构建弹性方案,监控维度涵盖三个指标:

为降低冷启动延迟,系统维持预热实例池,利用共享存储加速模型权重加载。在业务高峰期,系统可在分钟级完成计算资源扩容;低峰期自动回收冗余节点,优化计算成本。

4.4 防饥饿队列:别让低优先级任务永远等不到

多租户场景下有一个经典问题:高优先级任务不断涌入,低优先级任务永远排不上队。

调度引擎设立VIP、标准、批处理、低优四级优先级队列,采用改进的加权轮询算法(WRR)。正常负载下,VIP队列分配70%调度频次,标准业务占20%。

针对长尾任务,引入动态权重提升机制(Aging):任务在队列里等待超过300秒,优先级每分钟自动上调一级,直至进入高优执行序列。这个机制从根本上解决了低优先级任务的饥饿问题。

五、沙箱隔离:给每个Agent一个"独立运行室"

Agent具备工具调用和代码执行能力,这意味着一个行为异常的Agent有可能:

- 读取不该读的数据库字段

- 向外部地址发送敏感信息

- 执行恶意代码,破坏宿主机环境

- 通过高频资源占用拖垮整个集群

传统的基于"相信Agent会老实运行"的假设已经不够用了。沙箱隔离提供的是技术层面的强制约束,不依赖Agent的"自觉"。

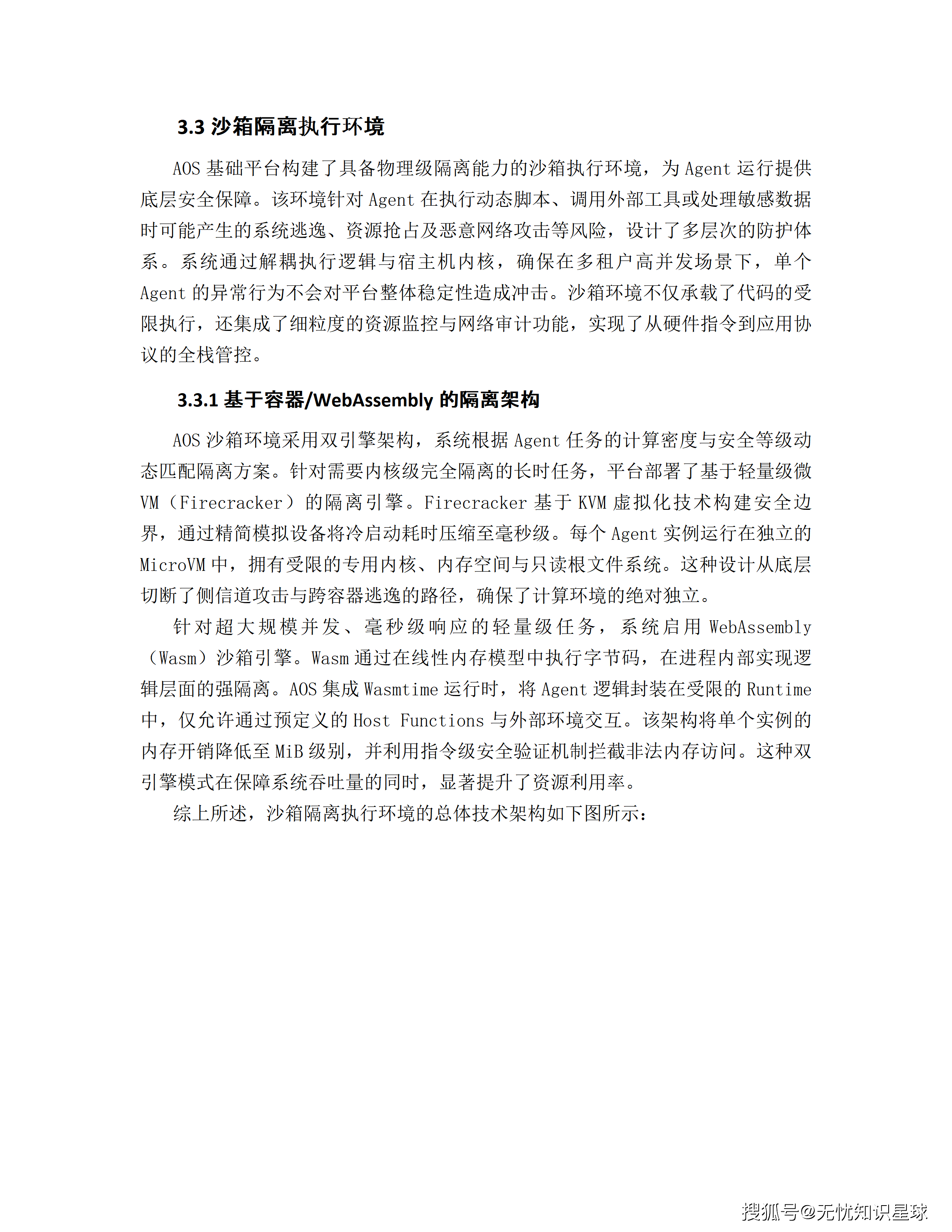

5.1 双引擎架构:根据任务类型匹配隔离方案

AOS沙箱采用双引擎架构,根据任务的计算密度和安全等级动态匹配方案:

Firecracker微虚拟机(适用于长时、高安全等级任务):基于KVM构建安全边界,精简模拟设备,冷启动压缩至毫秒级。每个Agent运行在独立的MicroVM里,拥有专用内核、独立内存空间和只读根文件系统。侧信道攻击和跨容器逃逸的路径从底层被切断。

WebAssembly沙箱(适用于高并发、低延迟的轻量任务):在进程内部实现逻辑层面的强隔离,内存开销降至MiB级别,通过指令级安全验证拦截非法内存访问。Agent逻辑只能通过预定义的Host Functions与外部环境交互。

两种引擎的组合,在保障吞吐量的同时实现了资源利用率的最大化。

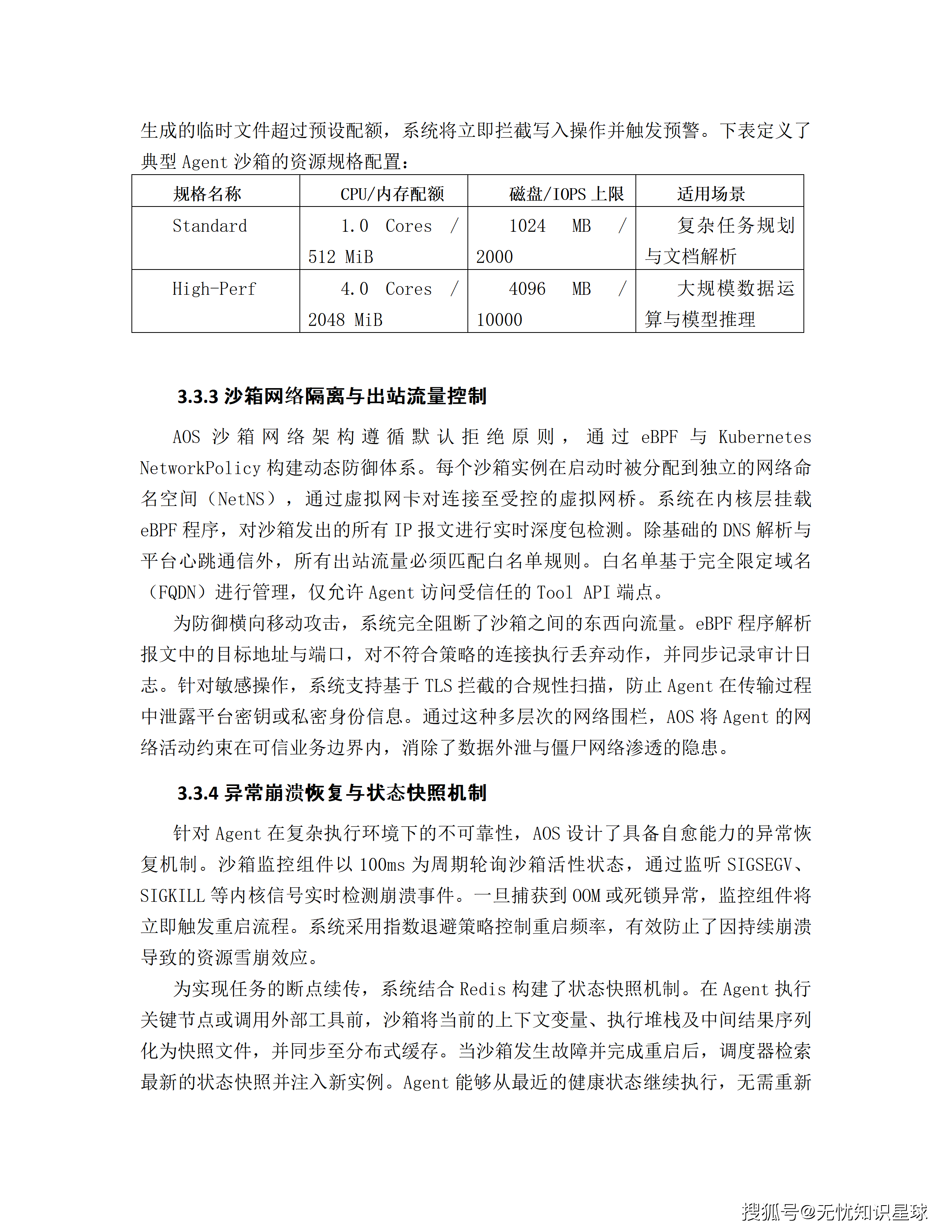

5.2 资源配额:硬性约束,不是建议

每个沙箱实例通过Linux Cgroups v2机制设置多维度硬性资源限制:

这些限制不是建议,而是内核层面的强制执行。一旦Agent超出内存配额,系统提前触发回收机制;磁盘写入超配额立即拦截并告警。

5.3 网络隔离:默认拒绝,白名单放行

沙箱网络遵循默认拒绝原则。每个实例分配独立网络命名空间,eBPF程序对所有出站IP报文做实时深度包检测。

只有符合白名单规则的流量才能放行——白名单基于完全限定域名(FQDN)管理,仅允许Agent访问受信任的Tool API端点。沙箱之间的东西向流量被完全阻断。

针对敏感操作,系统支持TLS拦截扫描,防止Agent在传输过程中泄露平台密钥或身份凭证。

六、Tool调用安全网关:把"Agent调用API"变成可审计的受控行为

如果沙箱解决的是"Agent运行环境安全"的问题,Tool调用网关解决的是"Agent与外部系统交互安全"的问题。

6.1 标准化Tool协议:消除语义歧义

Tool网关强制执行基于OpenAPI 3.0规范的插件描述协议。每个Tool描述文件必须包含语义描述、唯一操作标识(OperationId)和基于JSON Schema的输入输出约束。

协议还引入了x-agent-capability扩展字段,显式标注工具的适用场景、前置依赖条件和预期副作用。这个字段的价值在于:它让大模型在选择工具时有了更精确的参考依据,减少了"用错工具"的概率。

输入参数强类型校验:所有注册工具需声明参数的必选属性和约束条件,系统在请求进入执行引擎前完成预检,拦截率100%。输出采用统一响应模型,封装状态码、业务载荷、错误上下文和执行耗时,Agent可根据返回码自主触发重试、降级或路径切换。

6.2 鉴权与限流:零信任防御

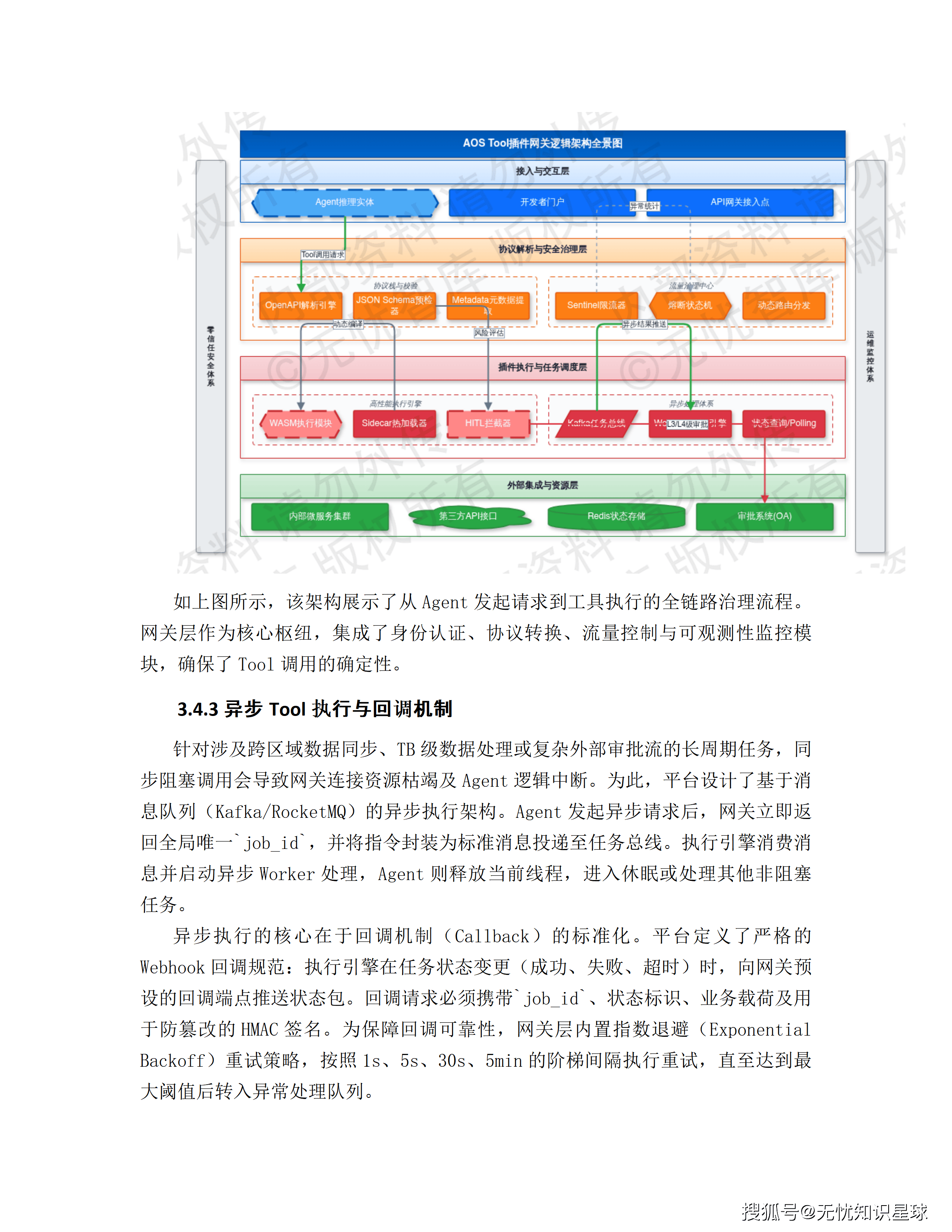

网关层构建基于零信任架构的安全防护:

- 内部微服务调用:mTLS双向TLS身份验证 + JWT权限透传。

- 外部第三方集成:OAuth2.0授权码模式或API Key模式。

- 实时权限校验:从统一权限中心检索Agent实体的RBAC策略,校验其对特定Tool资源的访问权限。任何越权尝试实时拦截并记录审计日志。

限流策略通过Sentinel组件实施:

熔断机制遵循标准状态机:Open(断路器打开)→ Half-Open(放行少量探测流量)→ Closed(恢复正常)。这有效隔离了单点故障,防止高耗时工具调用耗尽网关线程池。

6.3 高危操作的人工介入(HITL)

这是整个安全体系里最有价值的设计之一,也是最容易被忽视的。

当Agent尝试执行资金转账、核心数据库写操作、敏感配置修改等高风险操作时,系统不应该让Agent自主决定——哪怕Agent的逻辑完全正确。

Tool注册阶段按风险等级标注:L1(普通读)、L2(普通写)、L3(敏感操作)、L4(高危操作)。Agent调用L3/L4级工具时,网关自动挂起执行流,将调用上下文(含参数、推理路径、预期影响)封装为审批工单,推送给管理员。

管理员可以核准、拒绝,或修正参数后放行。确认后生成带数字签名的授权Token,网关校验通过后释放拦截。

整个过程记录在不可篡改的审计日志中:操作主体、时间、理由、执行动作,一条不漏。

平台还支持动态HITL策略:工作时间内、操作金额低于阈值时,可基于规则自动放行;非工作时间或跨域操作,强制触发人工复核。这在安全与效率之间找到了合理的平衡点。

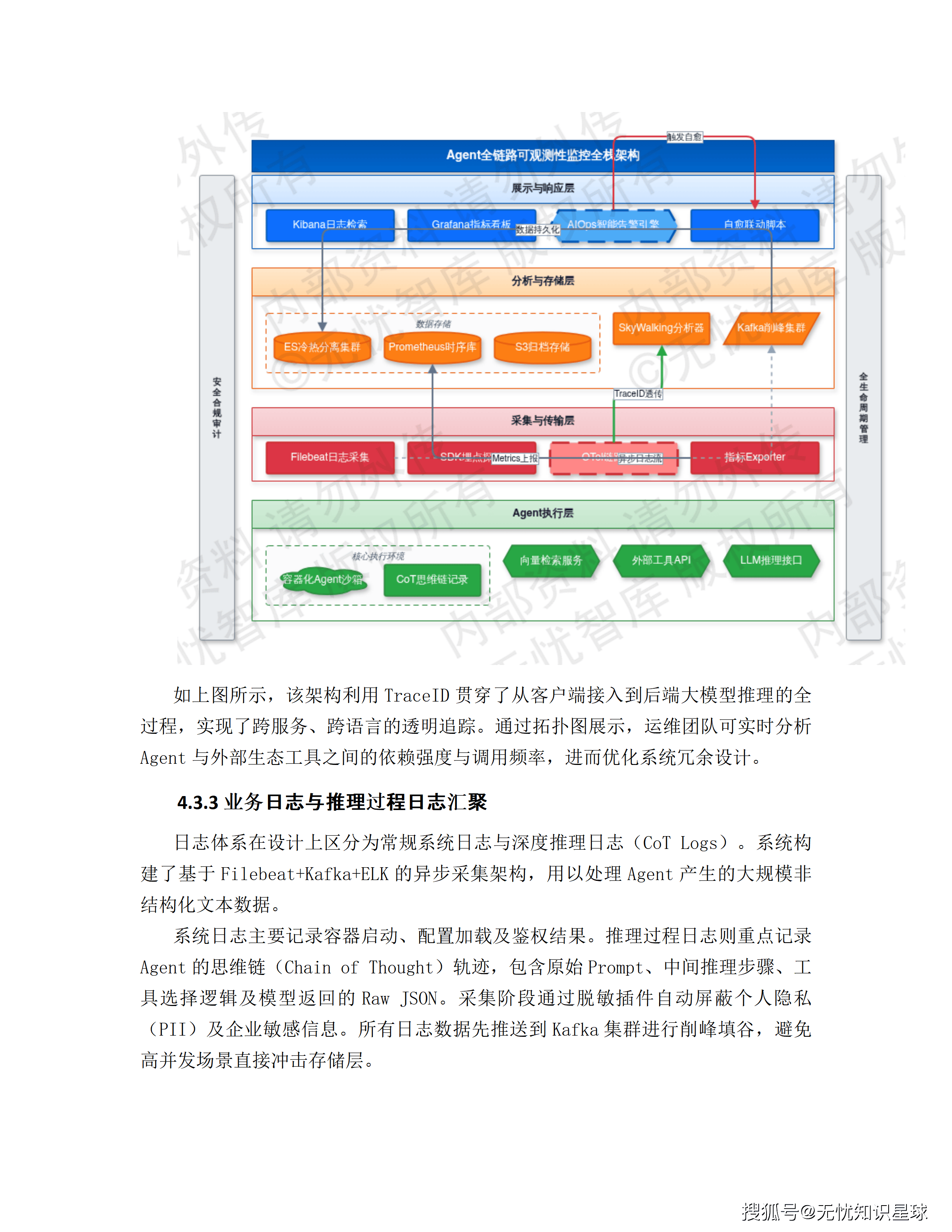

七、全链路可观测性:让"黑盒"变成"玻璃盒"

Agent的运行逻辑是非确定性的——相同的输入,不同的时间可能产生不同的输出。这使得传统的"结果正确/错误"二元判断不足以支撑有效的治理。

真正的可观测性需要能够回答:这个Agent是怎么想的?它做出这个决策经过了哪些步骤?它调用了哪些工具?工具返回了什么?最终响应是如何生成的?

7.1 思维链日志(CoT Tracing)

系统捕获Agent推理过程中的完整思维链记录:推理步骤序列、工具调用参数(Tool_name、Input_params、Response_raw)、实际消耗Token数和响应时延。

这些信息通过Fluentd异步采集,推送至Kafka消息阵列,分流至Elasticsearch建立索引。支持基于TraceID的全链路追踪,能够还原跨服务的完整调用拓扑。

当出现问题时,运维人员不再面对一个黑盒,而是一份详细的"决策日志"——可以精确定位是哪一步推理出了问题,还是工具返回了错误数据,还是Prompt导致了模型偏差。

7.2 价值观安全护栏

可观测性不只是被动记录,还包括主动拦截。

系统在模型输出的必经路径上部署内容过滤层,识别并拦截有害内容、敏感信息泄露和违规指令。技术实现上,轻量级安全模型对输出做语义分析,关键词过滤器处理已知敏感词,规则引擎处理结构化的合规约束。

这三层并行运行,综合评分低于阈值的响应被拦截、记录,并触发人工审核流程。

7.3 Agent行为基线与异常检测

系统为每个Agent建立行为基线:历史平均Token消耗、典型工具调用频率、响应时延分布。实时监控与基线偏差,当某个Agent突然出现调用频率暴增、Token消耗异常或高频调用不寻常的工具端点时,自动触发告警。

这种基于行为基线的检测,比静态规则更能发现未知的异常模式。

八、Agent全生命周期治理:从"上线"到"下线"的闭环管理

完整的治理不只是管运行阶段,而是覆盖Agent从创建到废弃的全生命周期。

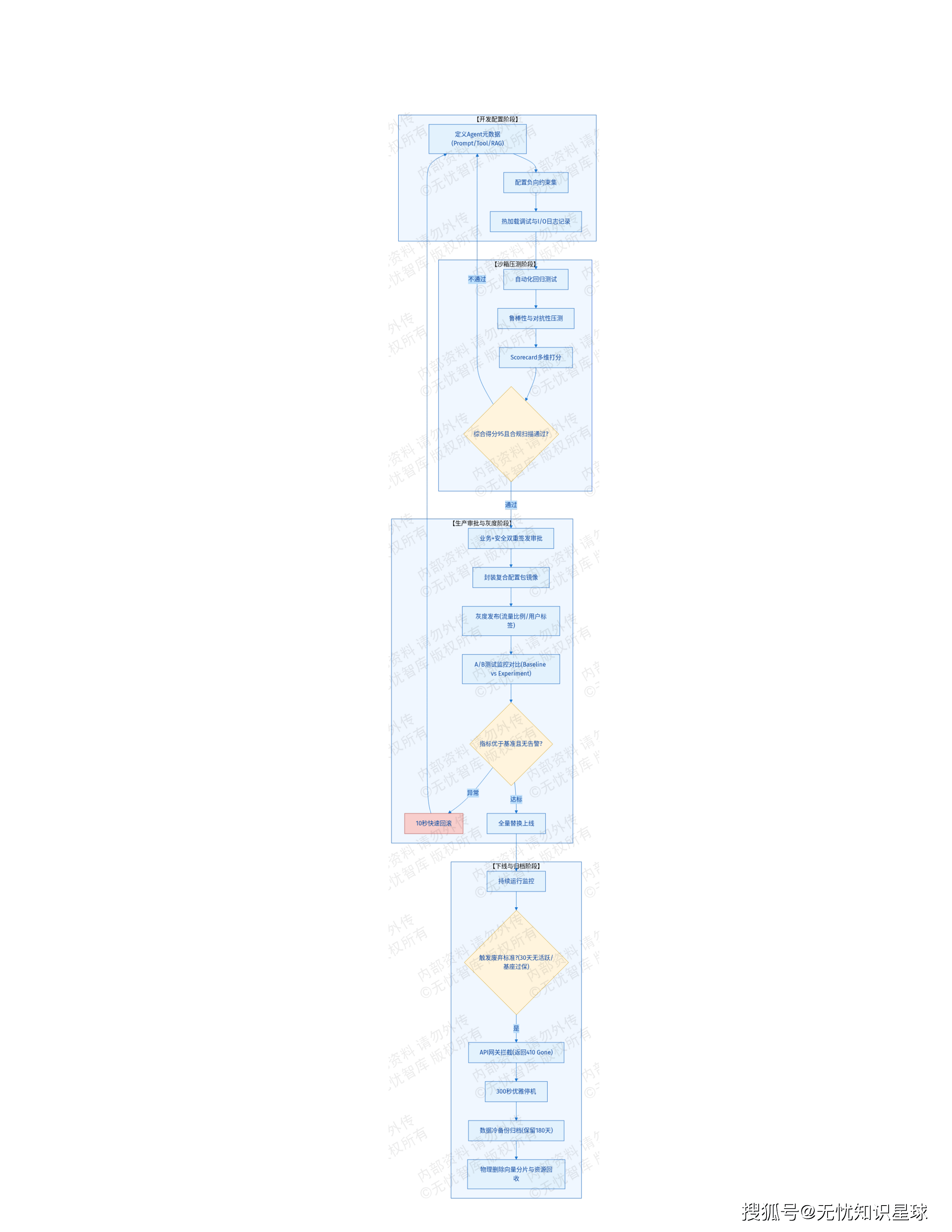

8.1 发布流程:三道强制门禁

开发配置阶段:定义基础模型选型、System Prompt、Tool Schema和RAG知识库索引。系统强制要求配置"负向约束集"——明确告诉Agent什么事情不能做,而不只是告诉它能做什么。

沙箱压测阶段:除基础功能验证外,重点执行Prompt鲁棒性压测和对抗性模拟——通过脚本注入模糊语义和恶意指令,量化评估模型在极端场景下的响应稳定性。综合得分≥95分且通过敏感数据合规扫描,方可进入审批流。

生产审批阶段:业务部门核对功能逻辑,安全团队评估模型合规风险,"业务+安全"双重签发制。

这三道门禁设计的核心逻辑是:宁可在测试阶段多花时间,也不在生产环境付出失控的代价。

8.2 版本管理与灰度升级

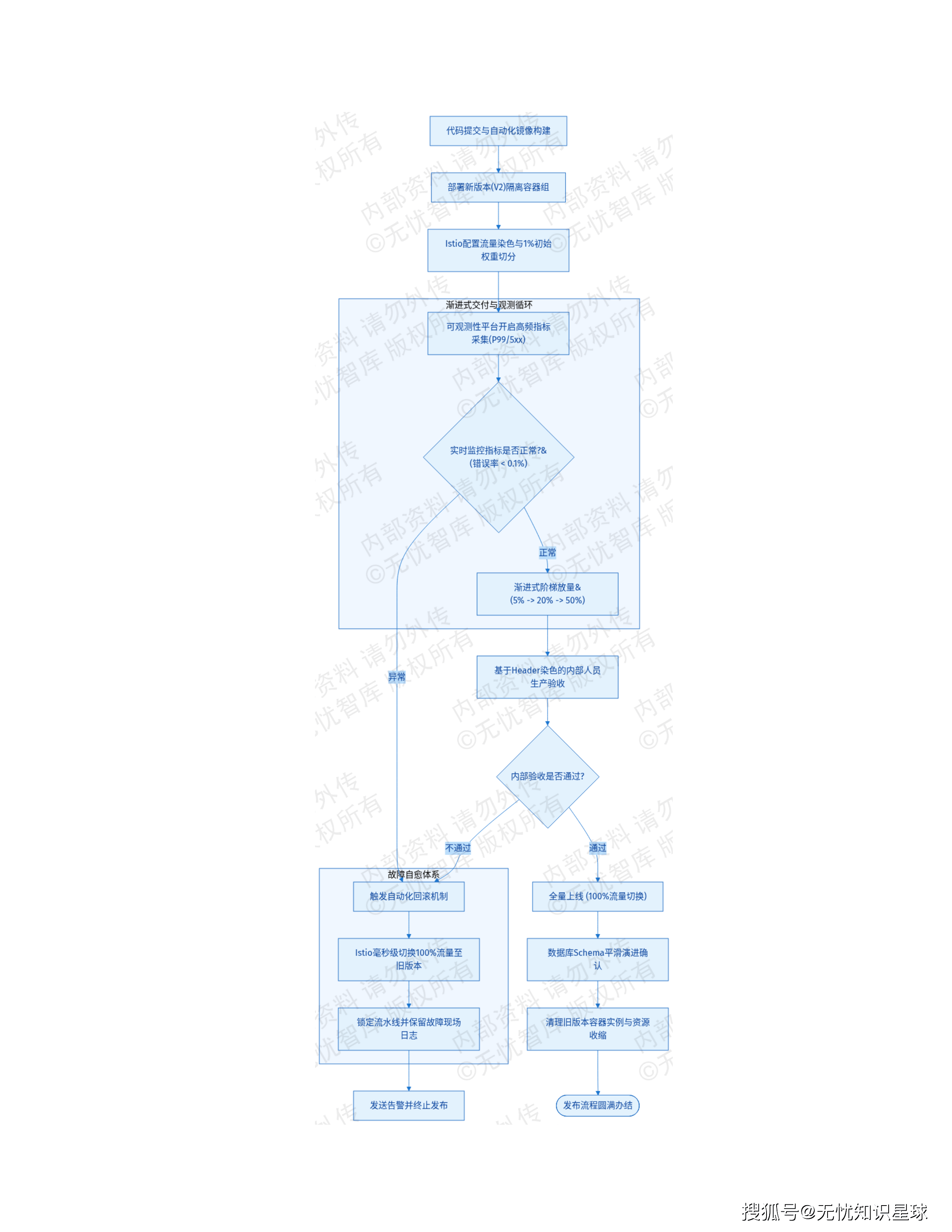

版本管理采用复合配置包模式,将Prompt文本、Tool Schema、模型超参数和关联知识库版本封装为统一镜像。基于语义化版本(Semantic Versioning)构建版本树,任何配置变更均触发版本号递增。

支持基于流量比例(1%-10%)或用户标签的灰度发布。灰度运行期间,A/B测试框架实时对比基准版本与实验版本的业务转化率、用户满意度和Token消耗成本,自动分析语义差异度并生成对比报告。

关键指标:支持SRE团队在10秒内执行版本回滚,对冲模型随机性波动引发的业务风险。

8.3 下线与数据清理:别让"僵尸Agent"成为安全隐患

Agent废弃标准:连续30天无活跃调用、关联业务系统已下线,或模型基座已过保。

"软下线"阶段:API网关拦截新请求,返回410 Gone,预留300秒优雅停机时间,允许存量长连接任务处理完毕。

数据归档阶段:对话日志冷备份,保留180天备审计;向量数据库分片物理删除;内存镜像和计算资源回收。

审计日志完整记录清理时间、执行人及受影响数据范围。这是Agent治理闭环的最后一道工序,防止已下线Agent的凭证或数据成为安全漏洞。

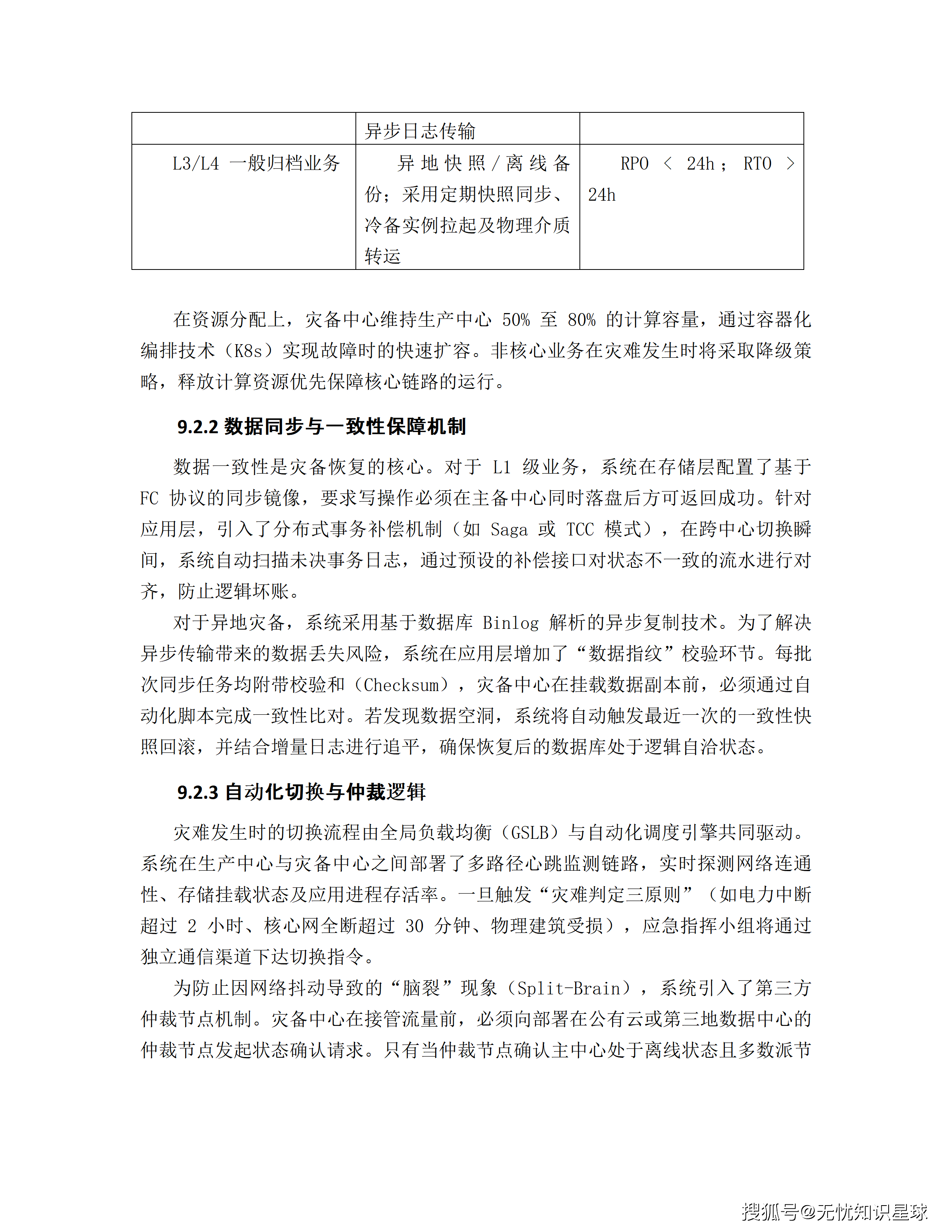

九、量化目标:说清楚这套体系能带来什么

方案最终要落地,就必须面对量化评估。这套AOS体系设定的具体目标值得在这里逐一梳理:

研发效能方面:

- Agent接入部署周期:从周级缩短至小时级

- 新业务上线的研发周期:缩短60%以上

安全治理方面:

- Tool调用安全审计覆盖率:100%

- 高危操作拦截准确率:≥99.9%

- 安全门禁扫描误报率:<0.1%

性能指标方面:

- 单集群并发TPS:≥10,000

- 跨域Agent路由延迟:<200ms

- 调度分配延迟:<100ms

- 沙箱冷启动耗时:毫秒级

资源成本方面:

- 系统整体资源利用率:提升40%以上

- 故障定位时长(MTTR):缩短50%以上

合规方面:

- 满足等保2.0三级标准

- 审计日志留存不少于180天

- 全栈信创适配(鲲鹏/海光+麒麟+达梦)

这些数字不是凭空写出来的。10,000 TPS依赖基于Spring Boot 3.2虚拟线程优化和高性能异步非阻塞框架;200ms跨域延迟依赖Kademlia DHT节点发现和SD-WAN路径编排;99.9%的拦截准确率依赖eBPF内核级监控和Seccomp系统调用过滤。每一项指标背后都有对应的技术路径。

十、那些绕不开的落地难题

写到这里,有必要从方案视角往后退一步,说一说实际推进中会遭遇的真实阻力。

难题一:存量系统的迁移成本

大多数集团企业不是从零开始建Agent,而是已经有了一批运行中的系统。把这些系统迁入AOS治理体系,涉及接口改造、鉴权逻辑替换、元数据补录。存量系统越多,迁移成本越高。现实中这往往是比架构设计本身更难的问题。

难题二:开发者习惯的改变

AOS引入了规范化的开发流程——强制元数据、测试门禁、双重审批。这意味着原来"随手就能起一个Agent"的灵活性被约束了。习惯了野蛮生长的团队,可能会对这套流程产生抵触。如何在规范性和灵活性之间找到平衡,是运营层面需要精细设计的问题。

难题三:HITL的效率瓶颈

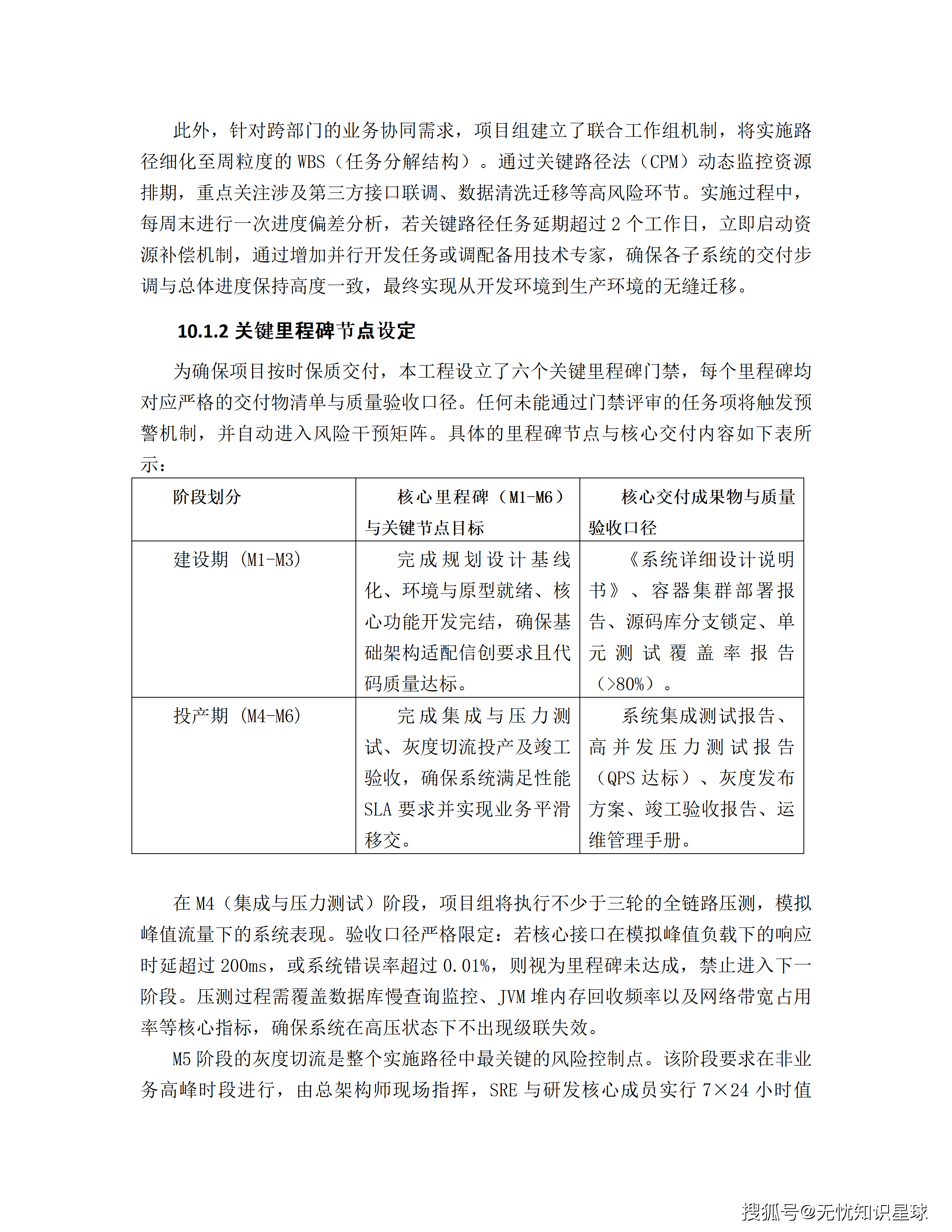

人工介入机制在理论上是安全的,但在实践中,如果审批流程设计不合理,会成为业务流转的瓶颈。一个需要频繁调用L3/L4级工具的业务场景,如果每次都要等人工审批,业务效率会大幅下降。动态HITL策略(工作时间内自动放行,非工作时间人工复核)是一个方向,但阈值的设定需要根据具体业务场景精细调整。

难题四:可观测性的存储成本

完整的思维链日志、工具调用记录、行为基线数据——这些数据的存储量远超传统业务日志。在大规模Agent集群下,这是一笔不小的存储成本。按180天留存标准,需要在存储容量规划上提前预算,冷热分离策略和压缩算法是降本的关键手段。

难题五:安全策略的动态调整

企业业务场景在演进,新的工具类型在出现,新的攻击模式在涌现。安全策略不能一次制定、永久生效,需要有动态调整的机制和专门负责这件事的团队。这要求企业在建设平台的同时,同步建立一套运营体系——这往往比技术本身更难规划。

总结

企业AI的下一阶段,不是"会不会用Agent"的问题,而是"能不能管好Agent"的问题。

AOS这套体系,本质上是把运行操作系统和App的工程智慧迁移到了Agent领域:统一注册发现、DAG编排调度、沙箱隔离执行、Tool网关鉴权、全链路可观测性、全生命周期治理——每一层都有对应的具体挑战,也都有可落地的工程解法。

那个让人担心的"影子AI"问题,技术层面已经有答案:Agent注册中心让每个实体可见;沙箱隔离让每个实体的行为受限;Tool网关让每次工具调用可审计;HITL机制让高危操作有人兜底;思维链日志让每个决策可溯源。

当然,这套体系的价值不在于它的完整性,而在于它能不能真正运转起来。架构再好,如果团队不愿意用、流程跑不通、存量系统迁不过来,那也只是一份好看的文档。

技术方向是清晰的。让这个方向变成现实,需要的是组织层面的共识和工程层面的耐心。

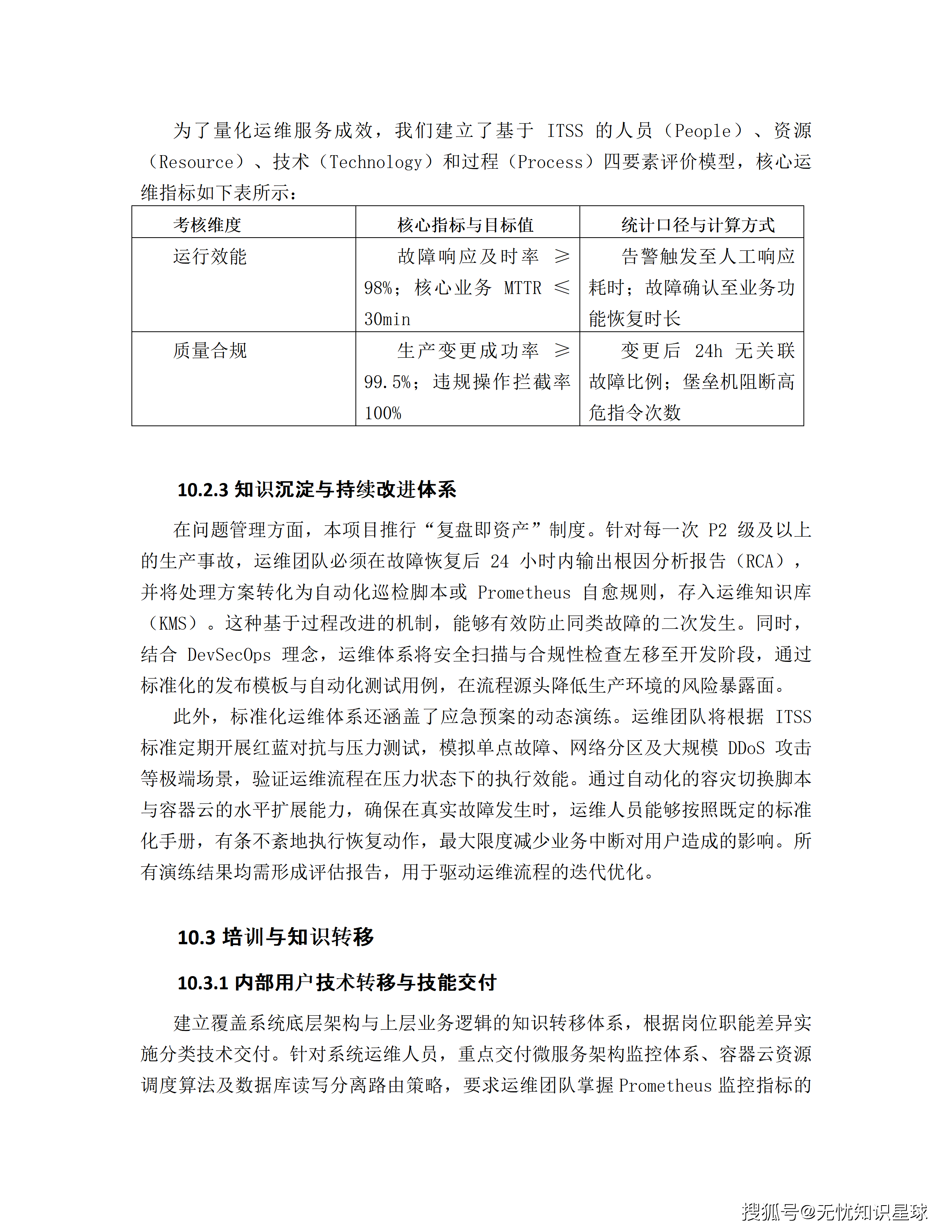

openEuler 是由开放原子开源基金会孵化的全场景开源操作系统项目,面向数字基础设施四大核心场景(服务器、云计算、边缘计算、嵌入式),全面支持 ARM、x86、RISC-V、loongArch、PowerPC、SW-64 等多样性计算架构

更多推荐

已为社区贡献1条内容

已为社区贡献1条内容

所有评论(0)